La branche ATAP de Google, celle qui conçoit des projets expérimentaux, a montré les avancés de Project Soli lors de la Google I/O 2016. Un projet qui permet d’interagir avec différents appareils en utilisant ses doigts et ses mains, mais sans les toucher. Google a justement montré une utilisation concrète et convaincante de sa technologie, sur une smartwatch.

Vous vous rappelez le Project Soli ? Non ? Ce n’est pas très grave, à la rédaction, personne ne s’en souvenait non plus. Project Soli a pourtant été annoncé et montré pour la première fois l’année dernière lors de la Google I/O 2015. Le but du projet est de concevoir une puce qui soit capable de reconnaître les mouvements, la vitesse et la distance des mains et des doigts (ou de n’importe quel autre objet) qui passe à sa portée. Google n’a pas inventé de nouvelle technologie, puisque le Project Soli se base sur les ondes émises par les radars.

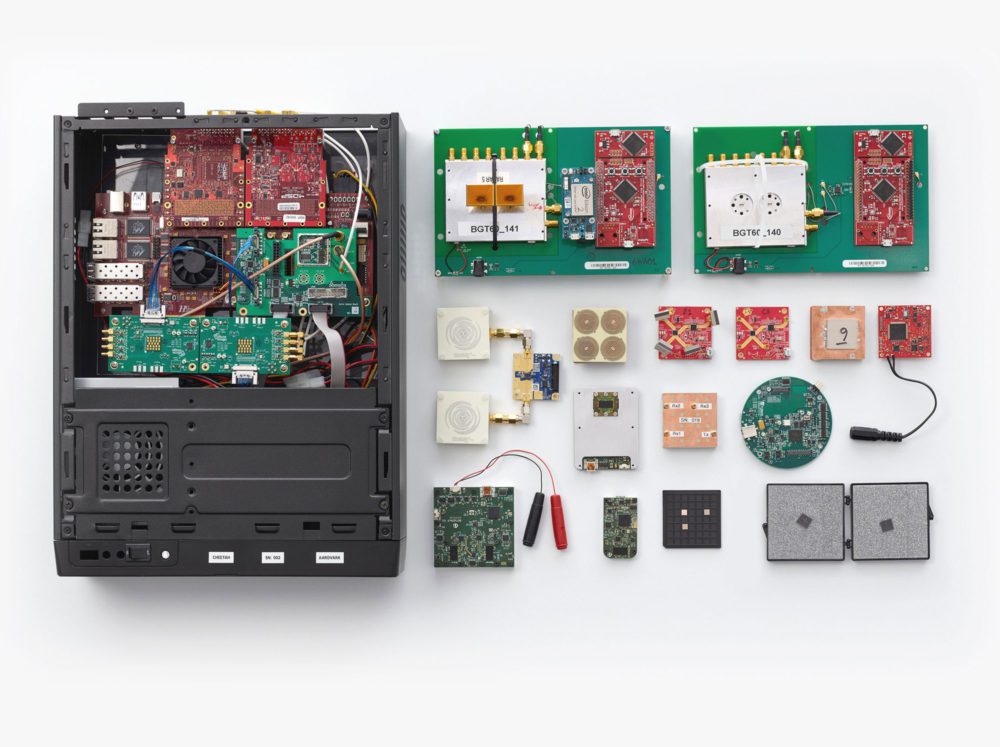

Plutôt discrète l’année dernière, l’équipe derrière le Project Soli a montré les avancées effectuées en un an lors de la Google I/O 2016, à l’occasion d’un atelier. En un an, l’équipe a considérablement progressé. En 2015, elle était parvenue à faire passer la taille du prototype d’une boîte à pizza à une carte SD. En 2016, elle a considérablement réduit la consommation électrique, le temps de latence et surtout a commencé à l’intégrer dans des appareils électroniques.

La démonstration commence à 27 minutes environ.

Et c’est justement ce qu’a montré l’équipe lors de la Google I/O 2016. Comme on peut le voir dans la vidéo ci-dessus, la puce a été intégrée à la fois sur une smartwatch de LG et une enceinte connectée de Harman. La démo la plus impressionnante est sans conteste celle avec la montre connectée.

À l’aide de gestes effectués en dehors de l’écran, il est possible de modifier l’affichage, de naviguer dans les menus de la montre et d’interagir très facilement avec la montre sans cacher l’écran avec ses doigts. Bref, en quelques minutes, le Project Soli montre qu’il est possible de rendre la navigation sur une smartwatch ergonomique.

Évidemment, ce mode contrôle relève pour l’instant (presque) de la science-fiction et l’on ne devrait pas voir arriver de tels moyens de contrôle avant quelques années encore. Mais voir que Google prend très au sérieux l’ergonomie des smartwatchs démontre que Mountain View croit réellement aux wearables.

Votre café et votre dose de tech vous attendent sur WhatsApp chaque matin avec Frandroid.

haha, putain c'est quoi encore cette merde, après la montre à la con ou tu parle avec le poignet comme un golmon, le ok google ou tu parle à ton tel avec un succès de compréhension des ordres de 40%, maintenant contrôler sa montre de à la con en faisant des geste de débiles dans les airs ? J'attend de rigoler devant le manuel d'utilisation haha, quelle immonde connerie

Marche parfaitement ?! Pour être entrain de développer avec la SDK Leap Motion je peux dire qu'on est loin du fonctionnement parfait même si il est commence à être bien poussé !

"Mais voir que Google prend très au sérieux l’ergonomie des smartwatchs démontre que Mountain View croit réellement aux wearables." Ca démontre surtout que meme google sait qu'a l'heure actuelle les Smartwatch c'est dla merde inutilisable

+1, surtout quand on lit : En un an l'équipe était parvenue à faire passer la taille du prototype d’une boîte à pizza à une carte SD. En 2016, elle a considérablement réduit la consommation électrique, le temps de latence et surtout a commencé à l’intégrer dans des appareils comme smart watch LG etc. C'est plutôt bon signe ?

Ce n'est pas de la SF, on l'a vu sur scène fonctionner... Je suis plus optimiste que le journaliste pour ce qui est du temps que l'on va devoir attendre pour voir ce genre de techno se démocratiser.

En français, on dit "projet".

"Évidemment, ce mode contrôle relève pour l’instant (presque) de la science-fiction et l’on ne devrait pas voir arriver de tels moyens de contrôle avant quelques années encore" ... De la SF !? Pas sûr y a déjà le LeapMotion qui fonctionne parfaitement et avec du Hardware très simple comme l'infra rouge, on fera ça plutôt dans 1 ou 2 ans pas plus plus ^^ Et peut-être sur les futurs HTC Nexus , lol

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

Gérer mes choix