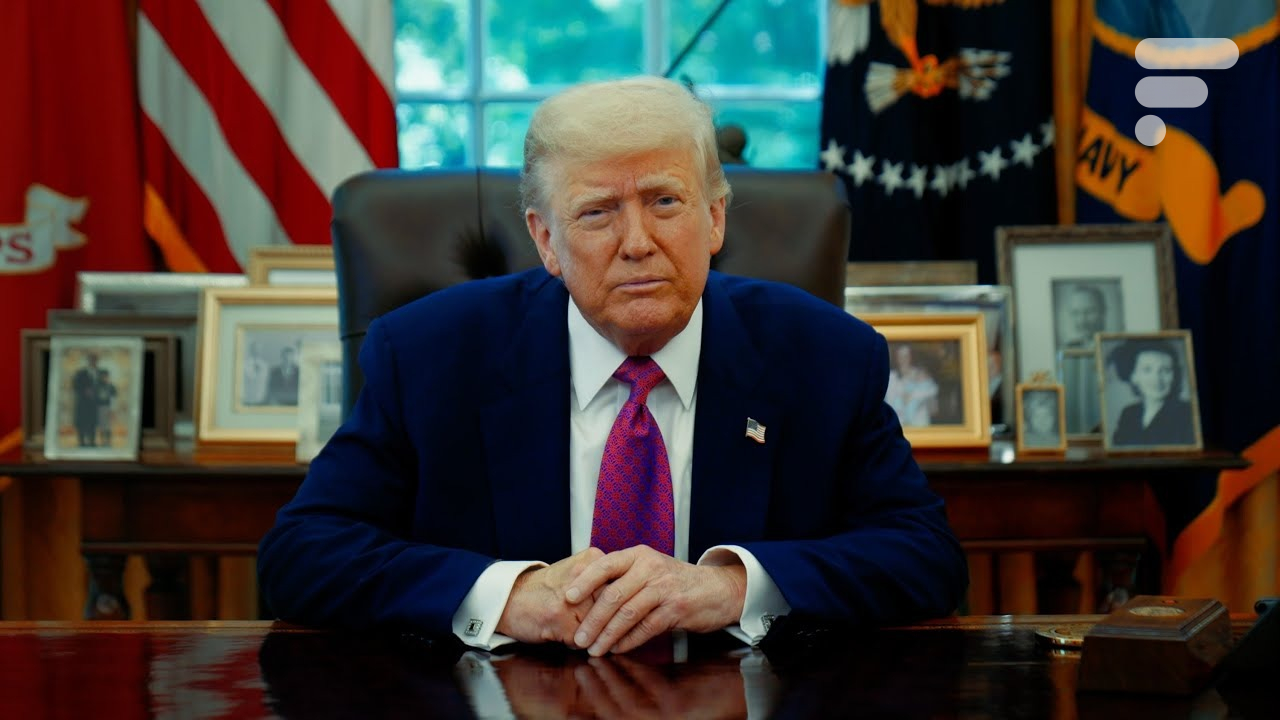

Anthropic vient de se faire éjecter du giron fédéral américain avec une violence rare. Tout a commencé par un post de Donald Trump sur Truth Social. Le président a ordonné aux agences fédérales de cesser toute utilisation des produits de la start-up sous six mois. Mais le coup de grâce est venu de Pete Hegseth, le secrétaire à la Défense.

Pour aller plus loin

Comment Anthropic Claude tient tête à la première puissance militaire au monde

Le Pentagone a officiellement désigné Anthropic comme un risque pour la chaîne d’approvisionnement. Pour bien comprendre, cette étiquette est normalement réservée aux entreprises liées à des puissances étrangères hostiles. Ici, le crime d’Anthropic est tout autre. La société a refusé de modifier ses conditions d’utilisation pour permettre au Département de la Défense (DoD) d’utiliser Claude pour la surveillance de masse domestique et les systèmes d’armes létales autonomes.

Dario Amodei, le fondateur d’Anthropic, reste droit dans ses bottes. Il préfère perdre des contrats juteux plutôt que de voir ses modèles piloter des « robots tueurs » sans supervision humaine. Mais cette posture morale a un coût immédiat. La décision de Hegseth interdit désormais à tout contractant du Pentagone, on pense à Palantir ou AWS, de mener la moindre activité commerciale avec Anthropic.

Un divorce idéologique et technique

Le conflit a atteint son paroxysme vendredi après-midi. Le Pentagone avait lancé un ultimatum : Anthropic devait accepter un accès « sans restriction » pour tout usage légal avant 17h30.

En clair, Pete Hegseth exigeait de pouvoir intégrer Claude dans des réseaux classifiés pour n’importe quelle mission, y compris celles qui font frémir les comités d’éthique. Anthropic a dit non.

Cette désignation comme risque de sécurité nationale est une arme nucléaire administrative. Elle paralyse l’écosystème autour de la marque. Si vous êtes un fournisseur du Pentagone, toucher à Claude devient radioactif.

Le jeu trouble d’OpenAI et les conséquences

OpenAI a donc récupéré la mise en acceptant de déployer ses modèles sur les réseaux classifiés du Département de la Guerre. La promesse de Sam Altman ? Maintenir une « responsabilité humaine » sur l’usage de la force. C’est suffisant pour satisfaire Pete Hegseth là où Anthropic avait bloqué. OpenAI occupe désormais le terrain laissé vide, demandant même au Pentagone d’imposer ces mêmes termes à toute l’industrie.

Pour Anthropic, la bataille se déplace maintenant sur le terrain judiciaire. L’entreprise a annoncé son intention de contester cette désignation de « risque » devant les tribunaux. C’est une question de survie commerciale. Si cette étiquette reste, Claude pourrait être banni de pans entiers de l’économie américaine qui dépendent, de près ou de loin, de contrats fédéraux.

Utilisez-vous Google News (Actualités en France) ? Vous pouvez suivre vos médias favoris. Suivez Frandroid sur Google News (et Numerama).

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.