Vous aimez les vidéos au ralenti ? La question est rhétorique : évidemment que vous aimez les vidéos au ralenti. Celles-ci sont absolument fascinantes, bien qu’il soit difficile de savoir précisément… pourquoi.

La tendance est en tout cas bien réelle dans l’univers mobile, les capteurs s’étant peu à peu améliorés jusqu’à offrir un super slow-mo à 960 fps. Et s’il était possible de faire tout aussi bien, voire même mieux, grâce à l’intelligence artificielle et à l’apprentissage automatique ? Nvidia le prouve.

Nvidia fait du super ralenti uniquement grâce à son logiciel

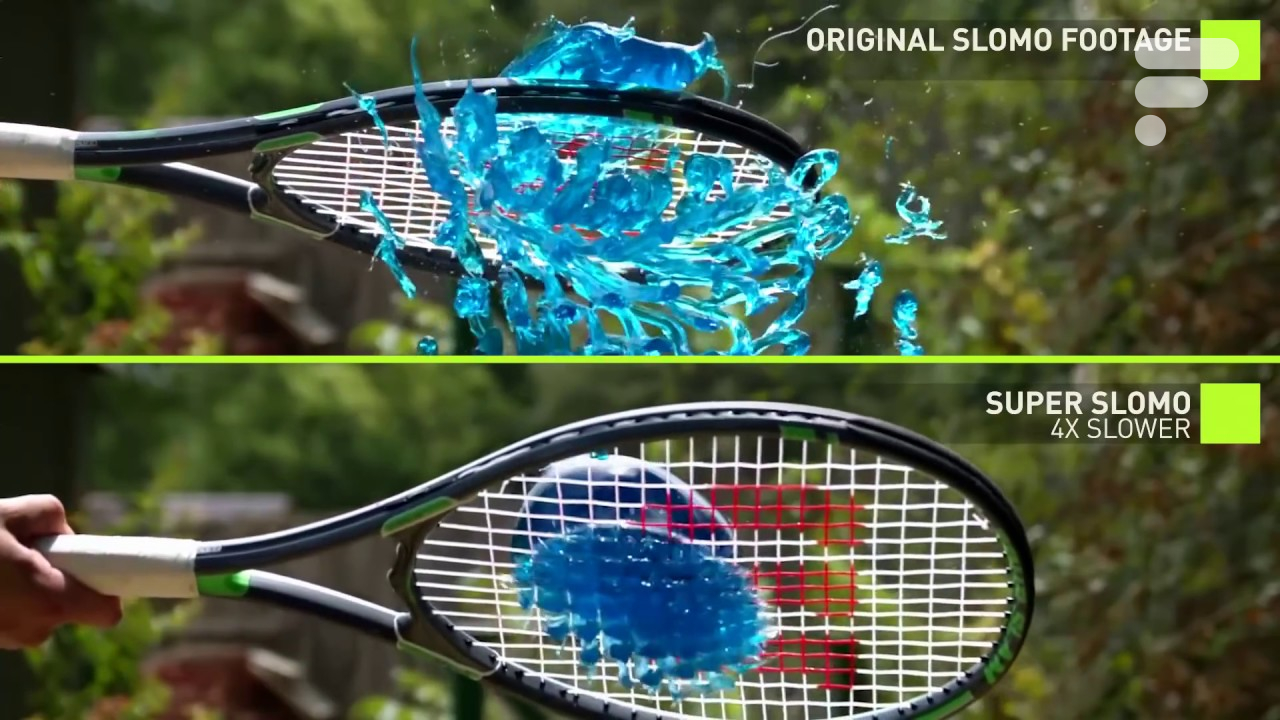

Arrivé à ce point et en parlant de vidéo au ralenti, je sais pertinemment que vous voulez avant tout voir la vidéo et profiter de ces ralentis si jouissifs. On se retrouve donc après le visionnage :

C’était agréable, n’est-ce pas ? Eh oui : ces vidéos ralenties (ou re-ralenties encore plus) n’ont été réalisées « qu’à partir » de l’aide de deux réseaux neuronaux créés par des scientifiques de Nvidia, soit… du logiciel.

À appliquer même après capture

Aussi, le grand bénéfice de cette solution est qu’elle peut être appliquée après avoir capturé une vidéo. L’algorithme de Nvidia utilise deux réseaux neuronaux en tandem. Le premier estime le flux optique, les mouvements de chaque objet en avant comme en arrière entre les images. Il crée ensuite un « champ de flux », un vecteur 2D des mouvements prédits à insérer entre les images.

Le second s’en sert pour interpoler des images recréées à partir de la vidéo source tout en déterminant l’évolution du flux optique potentiel. Ainsi, il est possible selon Nvidia de ralentir par un facteur 8, 15 ou même plus n’importe quelle vidéo en utilisant son algorithme.

Le résultat est en tout cas plus qu’impressionnant, la seule erreur visible à l’œil nu de son algorithme sur sa vidéo de présentation se situant sur la jambe droite du joueur de hockey lors de sa chute. Le reste est presque totalement transparent.

Pas encore prêt à une commercialisation

Ceci étant, ne vous attendez pas à voir débarquer la technologie de Nvidia dans votre smartphone de si tôt. Cette technique utilise en effet des GPU Nvidia Tesla V100 ainsi qu’un framework d’apprentissage automatique PyTorch très puissant.

Il réclame également beaucoup d’optimisation avant que celui-ci ne soit capable de réaliser ce rendu en temps réel. Si une sortie commerciale a lieu à l’avenir, il y a fort à parier que le rendu sera créé dans le cloud plutôt que localement.

Téléchargez notre application Android et iOS ! Vous pourrez y lire nos articles, dossiers, et regarder nos dernières vidéos YouTube.

Ouais ben ce principe d'interpolation existe depuis bien longtemps... le bon vieux plugin twixtor pour After Effects !!! Nvidia ne fait que améliorer ce principe avec des algorithmes plus performants. Il reste tout de même pas mal d'artefacts visibles sur certaines scènes si on regarde bien. Bref rien de bien révolutionnaire je trouve.

Si justement, ils y vont super doucement

Mets le en vitesse *2 :D

C'est joli mais ça se voit pour moi à certains moments que c'est artificiel encore. "Le résultat est en tout cas plus qu’impressionnant, la seule erreur visible à l’œil nu de son algorithme sur sa vidéo de présentation se situant sur la jambe droite du joueur de hockey lors de sa chute. Le reste est presque totalement transparent." Je suis pas d'accord, j'ai eu plusieurs moments où je me suis dit "nop ça fait pas naturel"

De manière générale je trouve dérangeant de diffuser à tout va de fausses images générées par des IAs, que l'on intercale avec des vraies, le tout automatiquement #FakeApp #VoCo pour compléter le tableau Autant les FX on a eu le temps de les voir venir et évoluer, on les (re)connais. Mais ça, ça risque de nous tomber dessus sâlement.

L'algorithme doit créer des images pour pouvoir ralentir la vidéo en gardant la fluidité. Du coup des images sont interpolées par le réseau de neurones mais ne sont pas réellement captées de la réalité. En gros 7 à 14 images sont "fausse" et rende ce dispositif parfaitement inutile pour de l’étude de mouvement. Mais ça fait le taff pour faire des ralentis jolie à partir d'une vidéo de 30/60 fps.

L'amour vaincra

d'ailleurs on voit (sur la danseuse notamment) les images rajoutées donne un effet de flou sur les bras

Hein?

Du coup ce sont de fausse images venant combler le trou entre deux "vrai" images. Pratique mais c'est un peu de la triche que de faire un slow motion qui est censé nous montrer le mouvement exact et donc qui ,ici, ne montre pas réellement ce qu'il c'est passé...

On a vraiment besoin de ce type de ralenti pour voir comment ce déséquilibré mental de Macron, essaie de diriger ce pays.

Comme avec la plupart des travaux de recherche, l'intérêt n'est pas visible immédiatement. Le type qui a inventé le transistor, il ne savait pas qu'on allait avoir des smartphones connectés à Internet dans la poche. Pourtant, c'est son invention qui a permis, des décennies plus tard, de faire ça. Là, on a un progrès en matière d'intelligence artificielle. Un ordinateur est devenu capable de re-créer des morceaux manquants de réalité. On ne sait pas encore à quoi ça va vraiment servir, mais il y a fort à parier que l'intelligence artificielle va aller beaucoup plus loin que ça. Mais pour aller loin, il faut commencer par ce genre de petits accomplissements.

Il faut lire la première ligne de l'article : "sans besoin d’un capteur photo spécial". Quel intérêt, alors que ces capteurs existent, qu'il suffit de les utiliser, et qu'ils donnent un résultat bien meilleur ? Eh bien c'est de la recherche, l'intérêt c'est de rendre possibles des choses qui ne l'étaient pas jusqu'ici, se faire de la publicité, faire des progrès dans un domaine pour éventuellement aboutir à un produit commercial dans le futur, garder une longueur d'avance sur ses concurrents dans un domaine (en l'occurrence ici, l'intelligence artificielle appliquée au traitement de l'image), etc.

Je veux bien le croire les ralentis ne peuvent servir qu'à la science et études, mais quel intérêt chez un particulier si ce n'est temporaire pour apprécier ?

Il me semble que pour ces sports, c'est du 10000 FPS, donc ça va forcément être un poil meilleur

À utiliser quand on fait des crêpes. Un ralenti lorsque qu'on retourne la crêpe... Ou alors quand on est maladroit, on peut filmer sa chute dans l'escalier. C'est peut-être toujours aussi douloureux mais on peut la revoir au ralenti.

C'est trop ralentie la.. j'aime pas.

On en a absolument besoin dans notre vie quotidienne !

Nvidia quand il s'intéresse à quelque chose il n'y va pas doucement, c'est super réussi!

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.