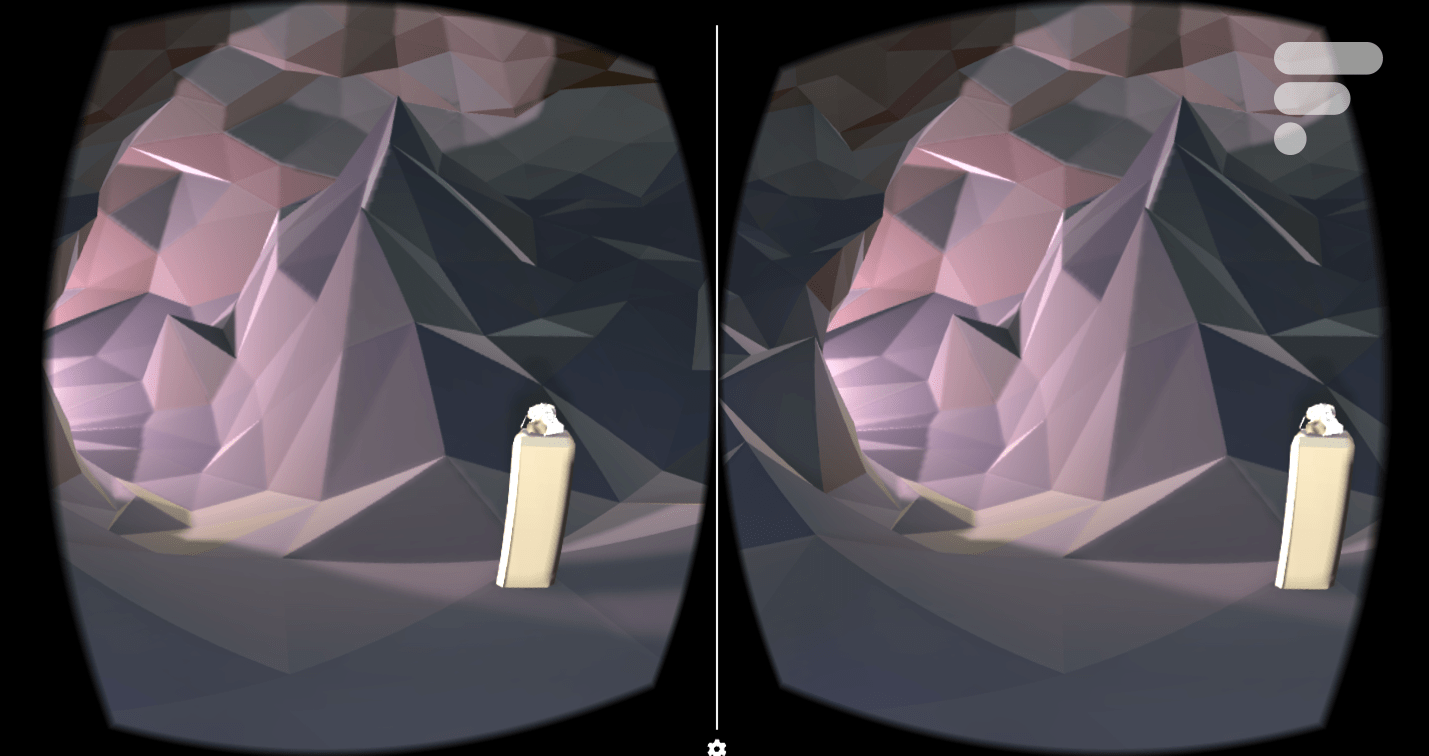

Avec la réalité virtuelle, les jeux comme le cinéma prennent une tout autre dimension. Pour les plus pointilleux, l’image n’est toutefois pas suffisante pour une réelle immersion sans l’ambiance sonore adéquate. Google a donc travaillé sur ce point afin de fournir aux développeurs tous les outils nécessaires à la création d’une ambiance à 360°.

Un son mieux géré

Jusqu’à présent, les développeurs tentaient de reproduire une ambiance sonore cohérente en produisant des sons en stéréo et en y ajoutant une certaine atténuation en fonction de la distance. Désormais, le son pourra être bien mieux géré grâce au nouveau SDK du Cardboard pour Unity et Android. Google explique par exemple qu’un son n’arrivera pas simultanément dans les deux oreilles de l’utilisateur, mais avec un léger délai en fonction de sa provenance (un son venant de la droite arrivera légèrement plus tard dans l’oreille gauche). L’environnement sera également pris en compte, permettant d’accroître la sensation de réverbération dans une grotte souterraine.

Une intégration naturelle

Les développeurs souhaitant ajouter ces nouveautés à leurs applications compatibles Cardboard pourront s’y atteler très facilement grâce à des éléments pré-intégrés, et ainsi aisément définir les paramètres de leur environnement sonore. Du côté des utilisateurs, aucun matériel supplémentaire ne sera requis, si ce n’est leur smartphone, comme d’habitude, ainsi qu’une paire d’écouteurs ou un casque afin de profiter pleinement de l’expérience.

Enfin, pour ceux qui auraient peur que leur smartphone ne soit plus assez puissant pour profiter de tels éléments, Google précise que le son spatialisé est généré en temps réel dans un thread séparé, en dehors du CPU principal. Optimisée pour les CPU mobiles, cette fonctionnalité ne devrait donc pas rendre les applications (beaucoup) plus gourmandes qu’elles ne l’étaient jusqu’à présent.

Il ne reste plus qu’à attendre maintenant que les développeurs tirent pleinement parti de cette nouveauté afin que nous puissions nous immerger visuellement et auditivement parlant dans des univers à 360°.

Chaque matin, WhatsApp s’anime avec les dernières nouvelles tech. Rejoignez notre canal Frandroid pour ne rien manquer !

Si un jour Google sort un produit plus haut de gamme, tu peux être sûr qu'il sera compatible avec le SDK du Cardboard. Et donc avec toutes les applications existantes, et des développeurs déjà habitués au SDK...

Ne compare pas des casques actifs à 700€ qui demande un pc à 700€ minimum comme locculus Avec des casques passifs à 2€ + un smartphone !

Aprés on est d'accord, ce n'est que pour certain usage précis de la VR. Principalement les videos et les photosphere. Pour le reste, les limites de réactivité des capteurs et de puissance de calculs des smartphones limitent ce qui peut être accompli.

Le but de Google est justement de permettre à tous d'avoir gratuitement un casque VR fonctionnel. Le carton permet justement de rendre le produit gratuit, comme à la poste. :)

Détrompe toi, le Cardboard peremt une adoption plus rapide, pour plus de bourses, et ils ont une division spécialisée, alors c'est loin d'être une perte de temps, et les casques confort standardisés Cardboard existent déjà

Je pense que les cardboard on un grand avenir (Il ne seront d'ailleurs plus en carton) nous somme juste dans une phase "bêta". La 4K va donner un bon coup de pouce.<i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

Faudrait que Google arrête de perdre du temps avec ses Cardboard, c'est bien vite fais mais la qualité ne sera jamais comme les casque à la Gear VR ou Occulus surtout après avoir tester ces produits là, on voit clairement la différence...Faut qu'ils lancent un produit à part, un carton c'est bien mais ça reste un carton quoi !

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.