La domination de Nvidia dans le secteur de l’intelligence artificielle n’est plus à prouver. L’entreprise auparavant se concentrait sur la conception et la production de cartes graphiques génère désormais une très large majorité de son chiffre d’affaires grâce à ses clients dans le secteur de l’IA, notamment grâce à ses cartes H100 présentes dans des milliers de centres de calcul à travers le monde.

Cette performance hors du commun (+27 % en un an) met ses concurrents sur la paille, précisément AMD et Intel. Si ces derniers ne sont pas en reste technologiquement parlant sur l’entrainement et l’inférence de réseaux neuronaux, leur retard est encore significatif.

Après avoir qualifié « d’insignifiante » l’arrivée des processeurs ARM sur PC, Pat Gelsinger y va encore de ses déclarations choc en affirmant que ce succès de Nvidia dans le secteur de l’IA serait dû à la chance du constructeur, mais aussi à sa malchance personnelle.

Nvidia s’est offert un potentiel « non mérité » selon Pat Gelsinger

Lors d’une table ronde organisée au sein de la prestigieuse école du MIT à Cambridge, Pat Gelsinger s’est exprimé quant à l’importance grandissante qu’a pris l’IA dans le quotidien des utilisateurs et donc, dans la conception des architectures processeurs actuelles.

Pour Gelsinger, Jensen Huang, président et fondateur de Nvidia, aurait été « extraordinairement chanceux » dans le secteur de l’intelligence artificielle. Il évoque notamment le projet Intel Larrabee qui, il y a 14 ans, aurait « changé la face de l’IA ». Il s’agissait à l’époque de cartes graphiques conçues par Intel pour concurrencer Nvidia à la fois dans le secteur du gaming, mais aussi des centres de calcul.

Le PDG d’Intel continue en regrettant qu’à ce moment-là, Nvidia avait un potentiel « non mérité » dans le domaine de l’IA, affirmant que le constructeur « ne voulait pas soutenir leur premier projet IA ». Le succès de Nvidia est surtout à attribuer à sa plateforme CUDA introduite en 2006, une technologie permettant d’exploiter la puissance d’un GPU pour différents types de calculs.

Un coup de chance ? Pas tant que ça

Ce n’est que plusieurs années plus tard, quand de nombreux chercheurs se sont mis à utiliser des cartes graphiques Nvidia pour entrainer des réseaux neuronaux afin de reconnaitre les éléments présents dans des images et vidéos que la firme a vu le potentiel de sa propre innovation. Selon l’article du New Yorker consacré à Jensen Huang, le vice-président de Nvidia a évoqué cette transition dans la stratégie de l’entreprise :

Il a envoyé un e-mail le vendredi soir pour dire que tout allait passer par le deep learning et que nous n’étions plus une entreprise de cartes graphiques. Dès le lundi matin, nous étions une entreprise d’intelligence artificielle. Littéralement, c’était aussi rapide.

Ce tournant dans l’histoire de Nvidia peut s’apparenter à un moment eurêka, mais celui n’est pas dû à la chance, mais bien à un long cheminement qui a pris son origine 10 ans auparavant. Si l’intention première n’était pas d’investir dans l’intelligence artificielle, cette réussite découle d’investissements successifs dans le domaine des GPGPU présents dans les centres de calculs.

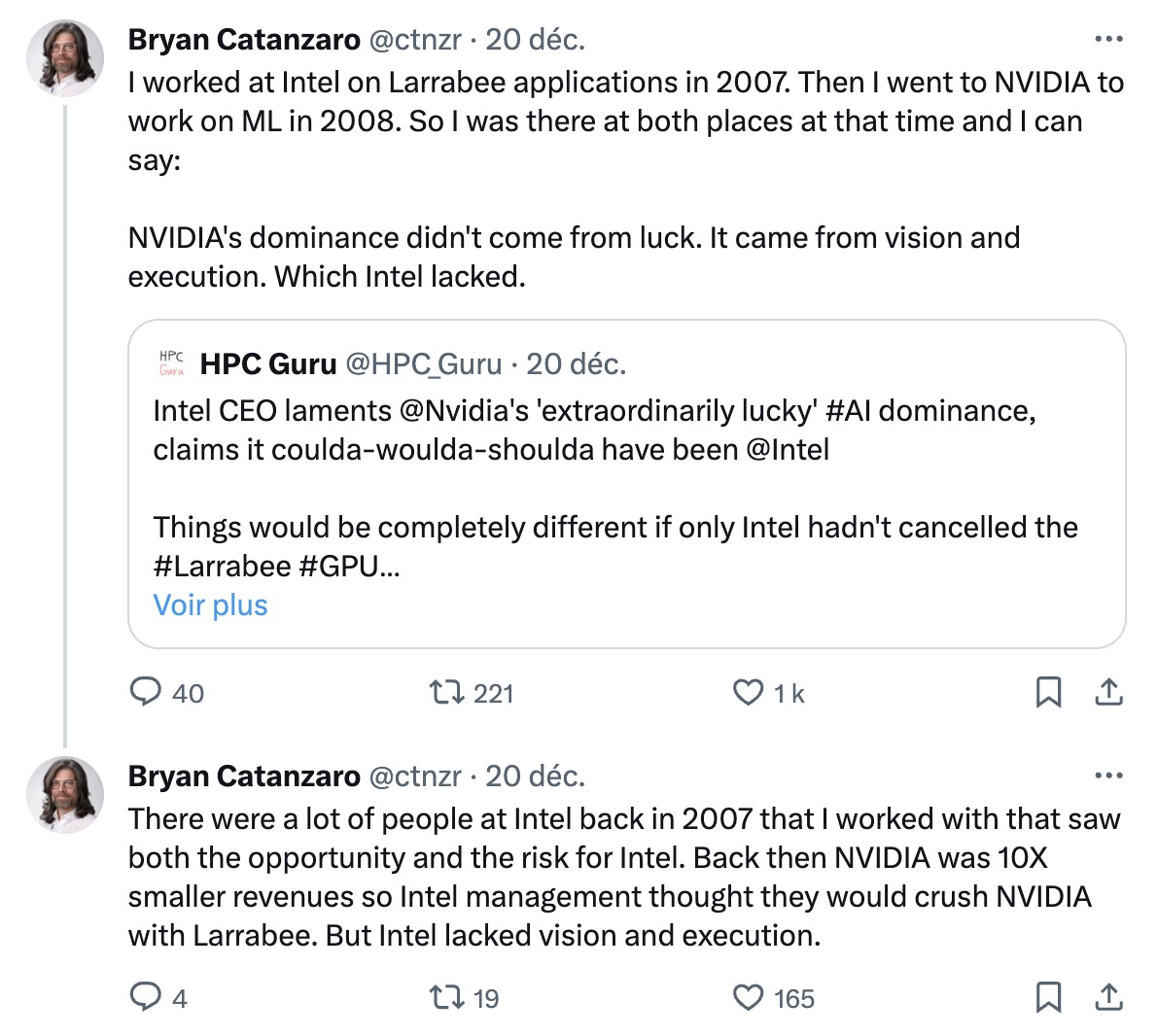

Pour Bryan Catanzaro, vice-président de la division de recherche deep learning chez Nvidia, et grand manitou du DLSS (Deep Learning Super Sampling), cette domination vient de tout sauf de la chance. Ayant aussi travaillé sur le fameux projet Larrabee chez Intel, celui-ci révèle :

En 2007, j’ai travaillé avec de nombreuses personnes chez Intel qui voyaient à la fois l’opportunité et le risque pour Intel. À l’époque, les revenus de NVIDIA étaient 10 fois inférieurs et la direction d’Intel pensait écraser NVIDIA avec Larrabee. Mais Intel a manqué de vision et d’exécution.

Intel n’est pas non plus à plaindre, et proposera ses propres NPU (Neural Processing Units) dans de nombreux PC en 2024 et 2025 avec ses prochaines générations de processeurs. XeSS, sa technologie de mise à l’échelle graphique, exploite des unités de calcul IA intitulées XMX et dépasse à certains égards le FSR d’AMD. Mais en concerne son implantation dans les centres de calculs neuronaux, il semblerait que son retard par rapport à Nvidia passe encore très mal.

Rejoignez-nous de 17 à 19h, un mercredi sur deux, pour l’émission UNLOCK produite par Frandroid et Numerama ! Actus tech, interviews, astuces et analyses… On se retrouve en direct sur Twitch ou en rediffusion sur YouTube !

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.