La lutte du monde entier contre l’épidémie de coronavirus en 2020 a forcément créé des tendances dans le domaine des nouvelles technologies. On peut penser au boom de l’industrie du jeu vidéo en plein confinement, ou à la montée en popularité des outils de télétravail et en particulier, ceux de réunions en ligne comme Google Meet, Slack, Microsoft Teams ou Zoom.

Cette dernière tendance fait face à plusieurs problèmes : la qualité du hardware, en particulier les caméras intégrées aux ordinateurs qui sont souvent de piètre qualité, et le débit nécessaire pour diffuser en direct le flux vidéo de notre caméra. Avec sa nouvelle technologie d’intelligence artificielle, Nvidia veut définitivement régler ce dernier problème.

Un débit nécessaire divisé par 1000

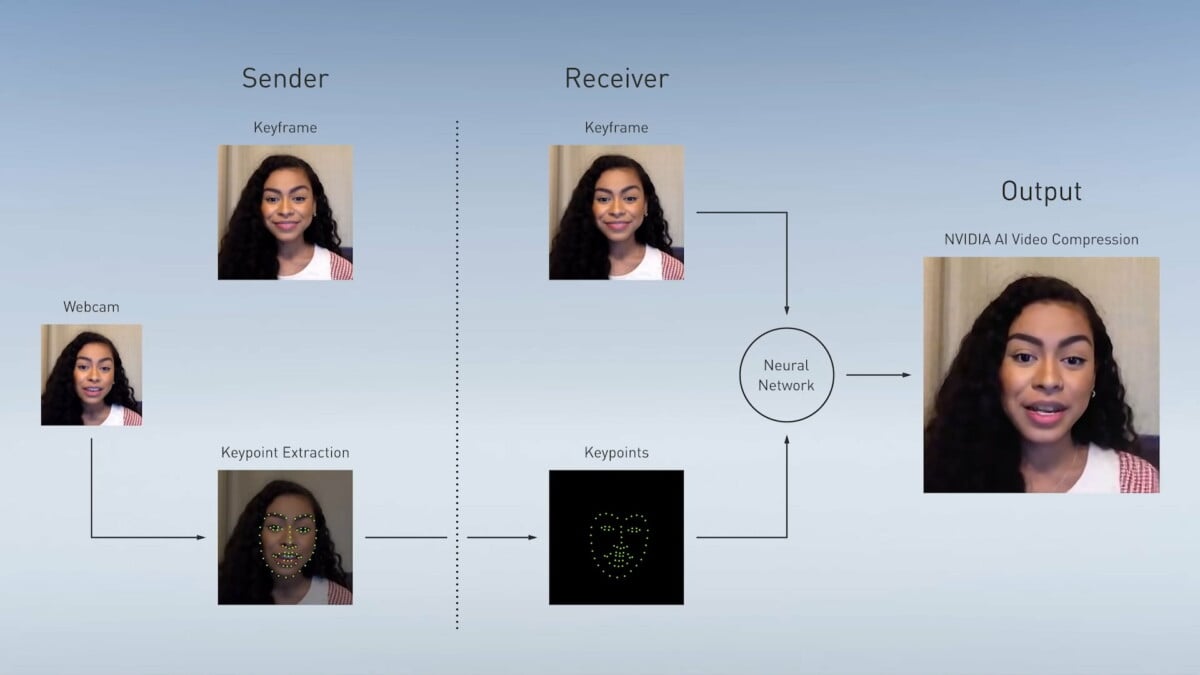

L’idée de Nvidia est assez simple sur le papier. Plutôt que d’envoyer « bêtement » votre flux vidéo compressé à vos correspondants, vous pouvez simplement envoyer une photo modèle de votre visage (Keyframe) et les informations de mouvement de votre visage (Keypoints). Le moteur d’IA proposé par Nvidia va alors reprendre cette photo et ces données, pour créer une version animée artificiellement de votre visage qui essayera de correspondre à vos mouvements réels.

Et si vous confiez la tonte de votre jardin à un robot tondeuse ? En ce moment, le modèle LUBA 3 AWD 5000 est accompagné d’un cadeau de taille : un Garage Standard offert (d’une valeur de 199 €) !

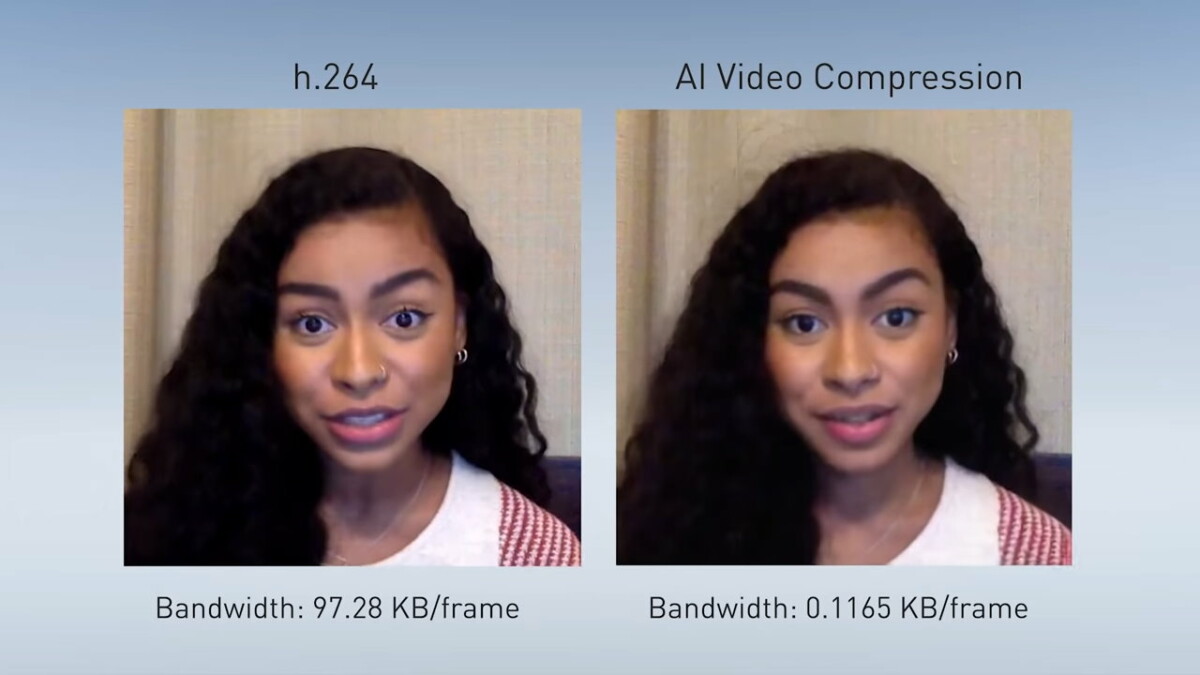

Tout l’intérêt est que l’envoi de cette photo et ces informations est beaucoup, beaucoup plus léger que l’envoi d’un flux vidéo complet. D’après Nvidia, si un flux vidéo h.264 peut occuper une bande passante de près de 97 Ko par image, sa solution Nvidia Maxine permet de passer à 0,117 Ko par image, soit un débit divisé par un facteur de 1000.

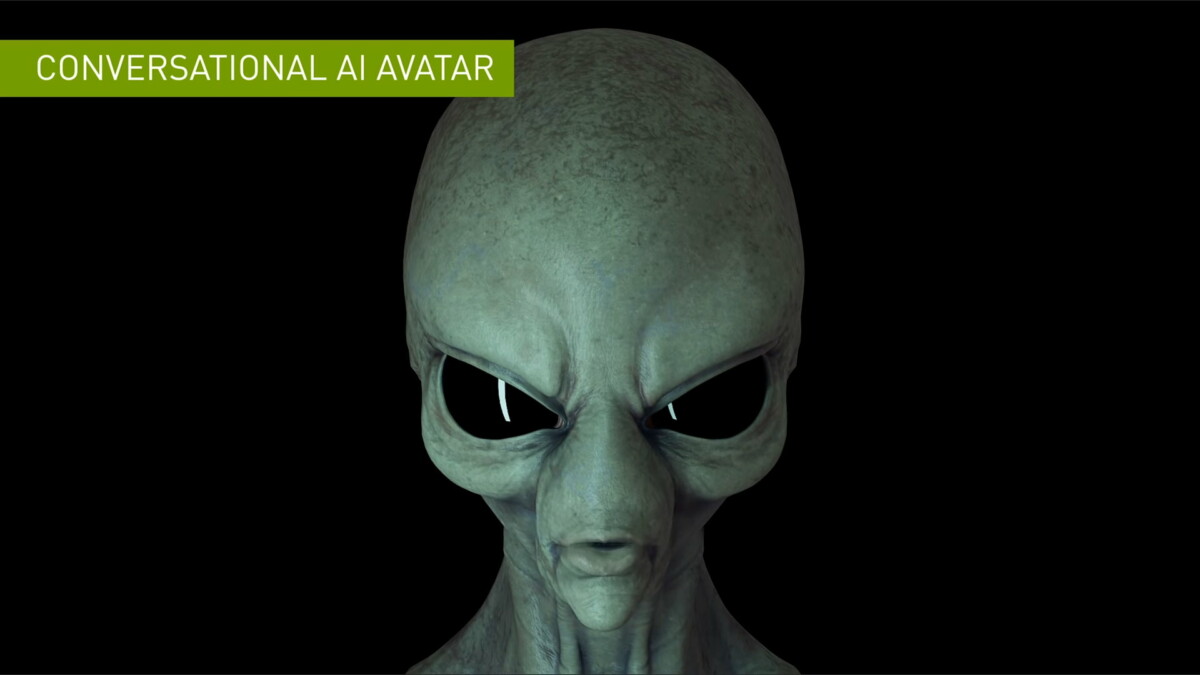

Ce n’est pas la seule chose que Nvidia propose de régler avec sa solution. La firme veut aussi utiliser son moteur pour améliorer la qualité de l’image, et ainsi obtenir un résultat final en HD 720p à partir d’images en 360p, ce qui n’est pas sans rappeler l’excellent travail de Nvidia avec DLSS dans les jeux vidéo. D’ailleurs, Nvidia a aussi présenté un système d’avatar 3D permettant de remplacer votre visage, par un modèle en image de synthèse qui imitera votre parole.

Ce n’est pas tout, Nvidia évoque aussi la possibilité d’améliorer l’image dans les situations de faible luminosité, à l’image du mode nuit des appareils photo de smartphones, et de modifier l’orientation du visage pour donner l’impression au correspondant qu’on regarde bien la caméra.

Une compatibilité avec tous les appareils

Nvidia souhaite faire tourner Maxine dans le cloud pour améliorer son efficacité et surtout le rendre accessible à n’importe quel appareil connecté. Il ne sera donc pas nécessaire d’avoir une carte graphique Nvidia, ce qui aurait limité l’outil aux ordinateurs.

Une technologie impressionnante, qui pourrait connaitre un vrai décollage quand le rachat d’ARM par Nvidia sera effectif. ARM occupe une place de choix dans les appareils connectés du monde entier.

Chaque matin, WhatsApp s’anime avec les dernières nouvelles tech. Rejoignez notre canal Frandroid pour ne rien manquer !

C'est plutôt une bonne chose de proposer une solution de webcam pour les faibles débit, dans un monde où le débit utilisé semble de moins en moins préoccupé les développeurs, au détriment des utilisateurs ayant des faibles connexions. Néanmoins, avec un tel système, ne serait-il pas encore plus facile de se faire passer pour quelqu'un d'autre ? Même s'il est déjà possible aujourd'hui de transmettre un flux vidéo d'une autre personne sur la webcam, il serait plus facile d'envoyer une simple photo et de parler normalement devant sa webcam en ayant ses mouvements du visage reporté sur la photo de quelqu'un d'autre

C'est exactement ça. Plus évolué !

Non je pense que vous avez mal compris, vous n'envoyez pas votre au serveur NVIDIA. Seulement la photo (keyframe) puis les points (keypoints). D'où le débit nécessaire réduit car c'est ensuite l'IA dans le cloud qui récompense la nouvelle image selon ces données. L'idée est bonne mais, ça reste assez proche des méthodes traditionnelles d'encodage vidéos avec les i-frame, p-frame et b-frame. Juste plus évolué.

Ben non, tu n'as rien compris du tout. Relis l'article et sois plus attentif.

Sachant qu'une partie de la communication passe par le non verbal, je ne trouve pas ça forcément déconnant que les gens allument leur webcam. Bon après sur les quinze doit bien y avoir treize touristes, donc ça n'a pas de sens que tout le monde allume sa webcam.

Après la on parle de video conference, pour laquelle la vidéo est envoyé en ligne en direct deja. C'est de l'encodage de stream en temps réel. Bon après c'est rien de bien folichon pour moi. Et ce terme IA me fait doucement rire comme bien souvent ^^

Le traitement sera sûrement local et en ligne

Tu n'envoies pas la vidéo, seulement une photo et les coordonnées de certains points de ton visage.

NVIDIA traiterait la vidéo dans le cloud pour pas que le pc est des difficultés. Donc en gros si je résume. On envois la vidéo en ligne pour économiser de la bande passante afin de ne pas avoir a envoyer la vidéo. Vidéo qui sera convertie par NVIDIA pour économiser de la bande passante. NVIDIA qui va certainement recréer le fichier de destination en ligne. Fichier vidéo en 720p qui sera envoyés a notre interlocuteur. Tout est hyper logique...

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.