Depuis 2017, AMD est revenue sur le devant de la scène face à Intel grâce à un changement de taille dans la conception de puce : le passage d’un design monolithique au concept de chiplets. En 2022, la firme cherche à reproduire l’exploit dans le monde des GPU dominé par Nvidia. Retour sur ce changement de conception qui pourrait bien devenir le design de référence à l’avenir.

Le design monolithique

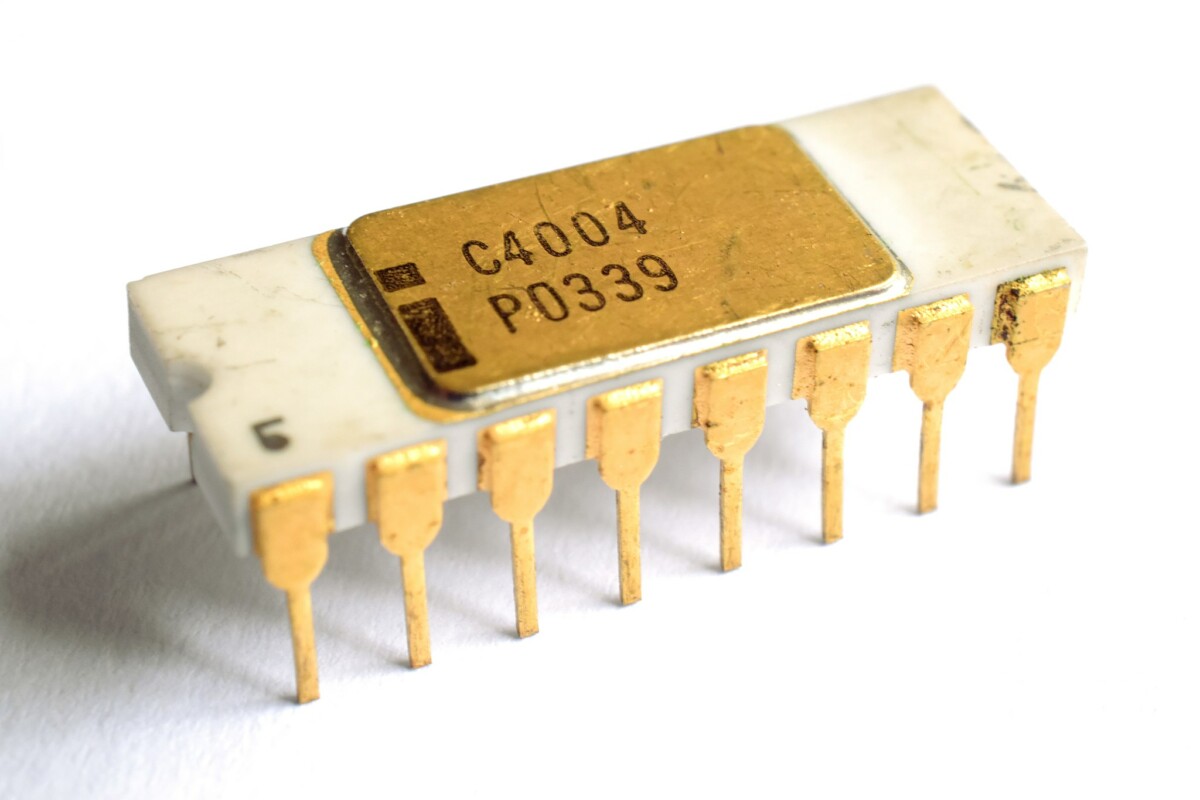

Le microprocesseur est, fondamentalement, l’un des éléments les plus anciens de votre PC au niveau de sa conception : un assemblage de portes logiques (dont la fonction est assurée par des transistors) visant à exécuter un jeu d’instruction régissant tout ce qui se passe dans votre ordinateur. La technologie et le processus de fabrication ont certes évolué depuis 1971 et la sortie de l’Intel 4004, considéré comme le premier microprocesseur commercialisé auprès du grand public, mais l’idée de base de cet assemblage de portes logiques est toujours restée la même.

L’un des principes fondamentaux du microprocesseur est d’intégrer toutes ses fonctions (les registres, les contrôleurs ou encore les UAL) dans un seul et unique circuit, soit un design dit monolithique. Très populaire dans les CPU de nos PC depuis des années, cette philosophie se retrouve de plus en plus en face d’une nouvelle méthode consistant à utiliser plusieurs circuits intégrés (appelés chiplets) dans un seul processeur.

Ces processeurs, parfois nommés MCM (Multi-chip Modules), peuvent avoir plusieurs avantages, notamment celui de permettre aux constructeurs une plus grande modularité dans les modèles de CPU proposés pour un coût plus ou moins réduit. C’est ce qui a permis à AMD d’enfin damer le pion à Intel sur le marché des CPU depuis 2017 avec ses impressionnants Ryzen. Le fabricant a annoncé sa détermination à reproduire l’exploit dans le monde des GPU, dominé par Nvidia, en reprenant cette technologie. Mais pour mieux comprendre leur intérêt, nous devons d’abord revenir à la fabrication d’un processeur.

Dis papa, comment on fait les processeurs ?

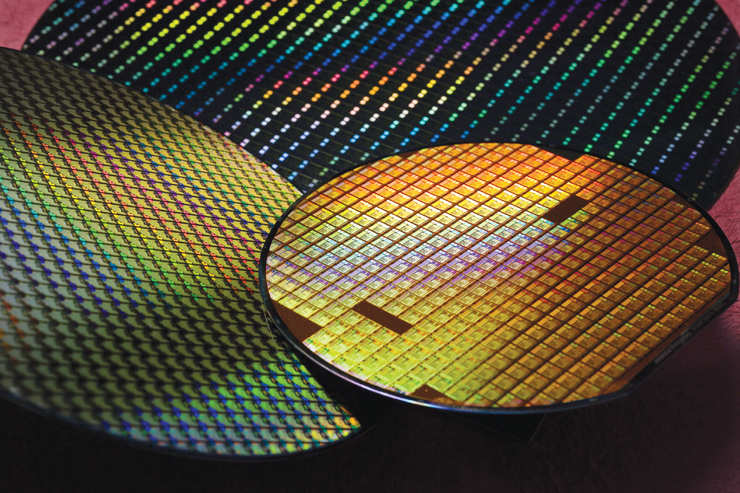

Le circuit intégré d’un processeur (appelé die) est fabriqué à partir d’une large plaque de silicium (nommée wafer) sur laquelle les différentes pistes comportant les transistors vont être gravées avant que le die lui-même soit découpé du wafer pour être inclus dans le processeur. La gravure, qui consiste à imprimer les pistes sur le die via une lumière ultraviolette, va donc définir le nombre et le placement des transistors sur ce dernier.

Et au risque d’énoncer une évidence, le nombre de transistors présents sur un die va avoir un impact direct sur ses performances. Aussi, l’augmentation du nombre de transistors est rapidement devenu un objectif pour les fabricants de CPU, et une des manières d’y arriver efficacement est d’améliorer la finesse de la gravure, puisqu’elle permet entre autres choses d’obtenir un plus grand nombre de transistors sur une surface plus contenue.

L’augmentation du nombre de transistors a fait l’objet d’une célèbre prédiction du cofondateur d’Intel, Gordon Earle Moore, qui annonce en 1975 que leur compte dans les processeurs va doubler tous les deux ans pour un coût de fabrication constant. Cette « loi de Moore » s’est réalisée avec une étonnante précision jusqu’au début des années 2000. À partir de cette période, les fondeurs se sont toutefois trouvés face à des limitations physiques de plus en plus difficiles à surmonter, et les nouveaux modèles de CPU montrent des améliorations moins impressionnantes que les précédentes générations. Juste après l’an 2000, le Pentium 4 atteint une finesse de gravure de 65 nanomètres, une avancée incroyable par rapport aux 10 micromètres de l’Intel 4004 en 1971, mais cette barrière ne sera pas franchie avant 2008 et les premiers Core 2 Duo en 45 nanomètres.

Une des conséquences malheureuses de ces limitations physiques, outre le ralentissement des améliorations, est également qu’il devient plus difficile de sortir des processeurs plus performants pour un coût de fabrication constant. Ce n’est qu’en 2017, alors que le leader Intel peine de plus en plus à innover dans un domaine qu’il domine pourtant toujours, que son concurrent AMD va trouver un moyen de contourner ces limitations physiques avec sa microarchitecture Zen et ses fameux chiplets. Ces derniers, couplés avec une finesse de gravure de 7 nm, lui permettent d’augmenter considérablement le nombre de cœurs de ses processeurs.

« On va manger… des chiplets ! »

Sur le papier, le principe d’un chiplet pour un CPU n’est pas très compliqué : plutôt que de graver un CPU complet sur une même surface d’un wafer, comme dans le cas d’un design monolithique, on sépare cette gravure sur plusieurs dies plus petits, donnant un processeur qui intègre en réalité plusieurs puces connectées entre elles. Ce type de design permet de créer plus facilement des processeurs plus puissants, ou tout simplement plus modulaires, mais aussi de réduire les coûts, nous allons y revenir.

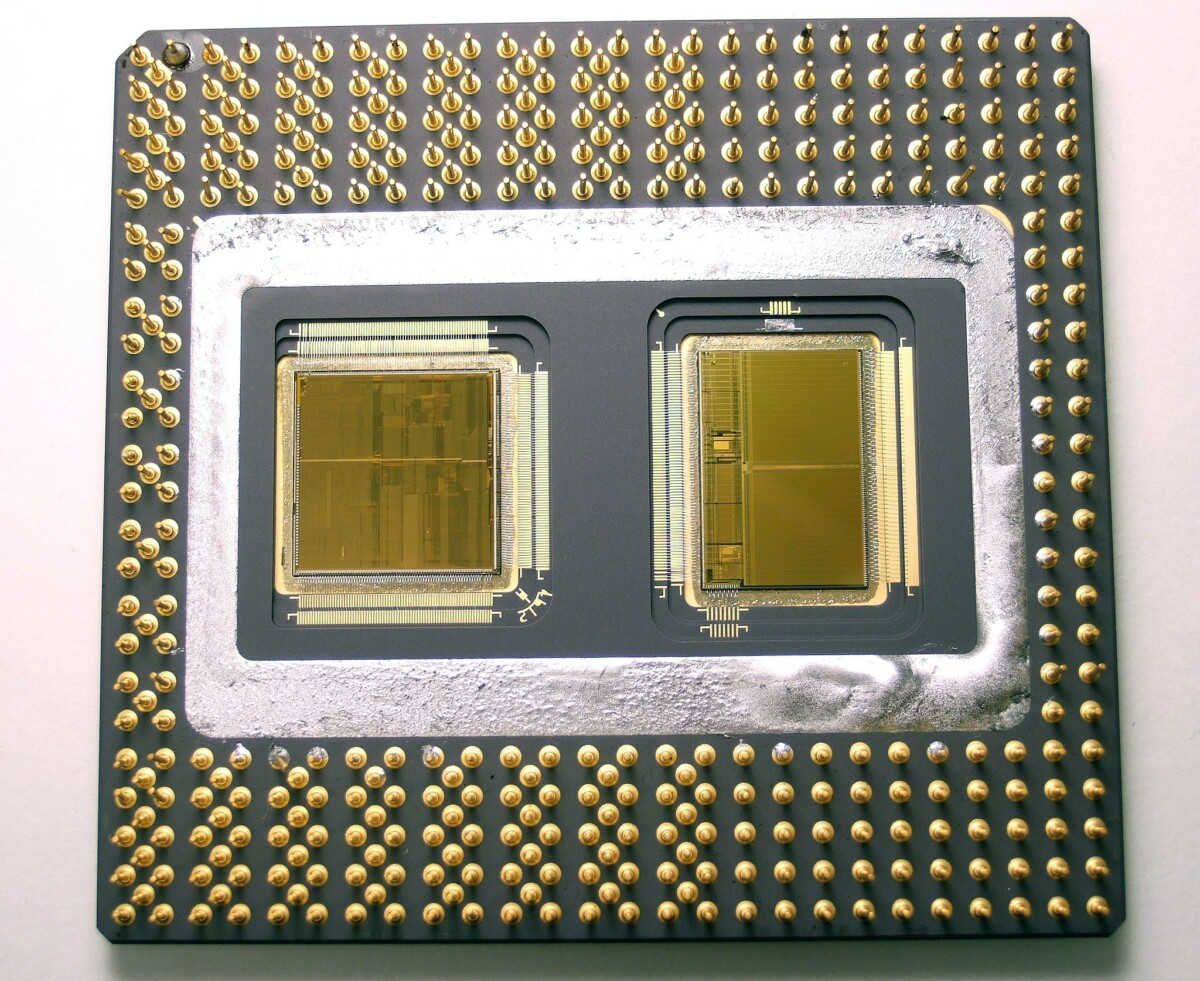

Mais AMD n’est pas l’inventeur des chiplets à proprement parler. Les puces de type MCM existent depuis des années, notamment avec le 3081 d’IBM, sorti en 1980, et qui embarquait deux dies. À l’époque, le but recherché n’est pas la réduction des coûts comme aujourd’hui, mais simplement une puissance de calcul hors normes, ce processeur étant prévu pour équiper les mainframe de la marque avec ce qui était essentiellement deux processeurs en un. Plus tard, cette idée de séparer le processeur en plusieurs dies a refait son apparition, notamment dans le Pentium Pro d’Intel en 1995 : cette fois, le CPU intègre un die pour le processeur central et un autre contenant la mémoire cache. De cette manière, Intel pouvait facilement réutiliser sa microarchitecture dans plusieurs gammes différentes de puces, proposant des tailles de cache différentes pour ses processeurs en les couplant simplement avec un autre chiplet pour créer le modèle désiré.

Cette modularité, ainsi que la fiabilité qu’elle apporte, va vite devenir un des principaux avantages des chiplets, notamment dans une logique de réduction des coûts. En effet, lorsqu’un fondeur grave plusieurs dies sur un wafer, il doit ensuite tester la viabilité des circuits obtenus, et ainsi déterminer ceux qui seront bons pour la commercialisation ou non. La moindre poussière sur le wafer au moment de la gravure peut conduire à un die défectueux et à sa mise à la poubelle, et donc à la perte d’une partie plus ou moins importante de la production. En découpant la gravure d’un CPU en plusieurs parties plus petites on mitige bien plus efficacement les risques de perte : une surface de gravure plus contenue signifie une chance de perte moindre. De même, un chiplet défectueux peut être remplacé par un autre identique, et le CPU n’est pas perdu. Dans le cas du Pentium Pro, cette modularité est également ce qui a permis à Intel de sortir le modèle à 200 MHz dans trois versions avec différentes tailles de cache : 256, 512 ou 1024 Ko, un choix assez rare à l’époque pour une seule et même puce.

AMD surpasse Intel grâce aux chiplets

Jusqu’à récemment, les CPU de type MCM étaient principalement utilisés dans les System on a Chip (SoC), très populaires notamment dans les smartphones. Ils consistent en un processeur central qui contient tout le nécessaire sur plusieurs dies : un CPU, un circuit graphique ou encore la mémoire vive. Qualcomm, Samsung et Apple équipent ainsi l’écrasante majorité des smartphones du marché avec ces puces au design modulaire, mais le monde des ordinateurs personnels n’y avait que très peu goûté en dehors de quelques modèles destinés aux usages professionnels.

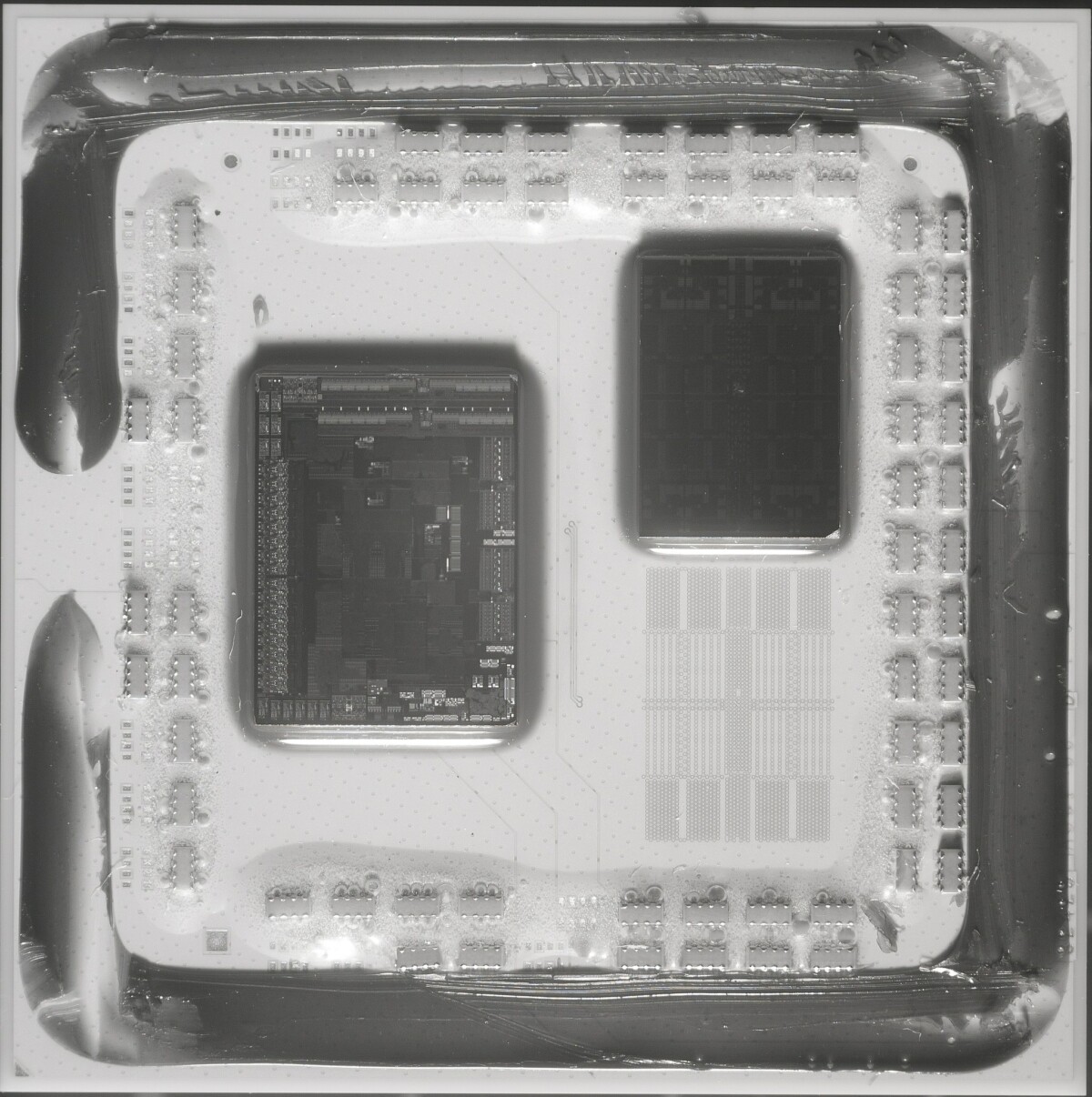

Du moins jusqu’à ce qu’AMD l’adopte avec le succès que nous connaissons dans sa microarchitecture Zen en 2017. À la base de cette microarchitecture se trouve le Core Complex (CCX), qui se retrouvera dans tous les processeurs de la marque. Concrètement, il s’agit d’un circuit embarquant 4 cœurs ainsi que les différentes mémoires cache, et qu’AMD va réutiliser à l’envi dans les multiples gammes de ses CPU pour créer des modèles plus ou moins puissants. Ceux-ci doivent toutefois être agencés dans des Core Chiplet Die (CCD), qui seront les dies effectivement gravés par le fondeur pour être intégrés aux CPU. Chaque CCD peut contenir jusqu’à deux CCX pour un total de 8 cœurs par CCD. C’est ainsi que dès 2017, le constructeur a pu proposer une gamme assez large de processeurs de 4, 6 et 8 cœurs, avec ou sans hyperthreading, pour un prix bien plus raisonnable que son concurrent Intel. En effet, en utilisant systématiquement le même design, et donc le même die pour tous ses processeurs, AMD était alors capable de réduire considérablement ses coûts de production.

Et ce n’est pas tout : étant donné que les CCD sont essentiellement des chiplets qui peuvent se connecter entre eux (via un procédé que la marque nomme Infinity Fabric), AMD s’est offert l’option de sortir des CPU embarquant deux CCD, soit un total de 16 cœurs (quatre CCX) sur sa gamme Threadripper. Le passage à de nouvelles microarchitectures (Zen+, Zen 2, Zen 3 et prochainement Zen 4) a conservé cette philosophie de CCD unique qu’on retrouve dans tous les processeurs du constructeur.

En 2019, avec la sortie de Zen 2 et des Ryzen 3000, AMD pousse encore cette logique en accompagnant tous ses CCD d’un nouveau chiplet, un Input/Output Die (I/OD). Il s’agit d’un circuit chargé de gérer tous les transferts de données sur les différents bus opérés par le CPU, notamment le PCI-Express 4.0, tout nouveau à l’époque de sa sortie. C’est aussi à cette époque que le constructeur lance le premier processeur 16 cœurs (2 CCD) pour le grand public avec le Ryzen 3950X (sorti à près de 800 € tout de même), ainsi qu’un Threadripper 3990X qui totalise 64 cœurs sur 8 CCD.

C’est aussi la démarche d’Apple avec sa gamme de puces M1, M1 Pro, M1 Max et M1 Ultra. Cette dernière est notamment l’assemblage de deux puces M1 Max. Chez Apple, la connexion ne se nomme pas Infinity Fabric, mais UltraFusion.

Une initiative pour standardiser les chiplets

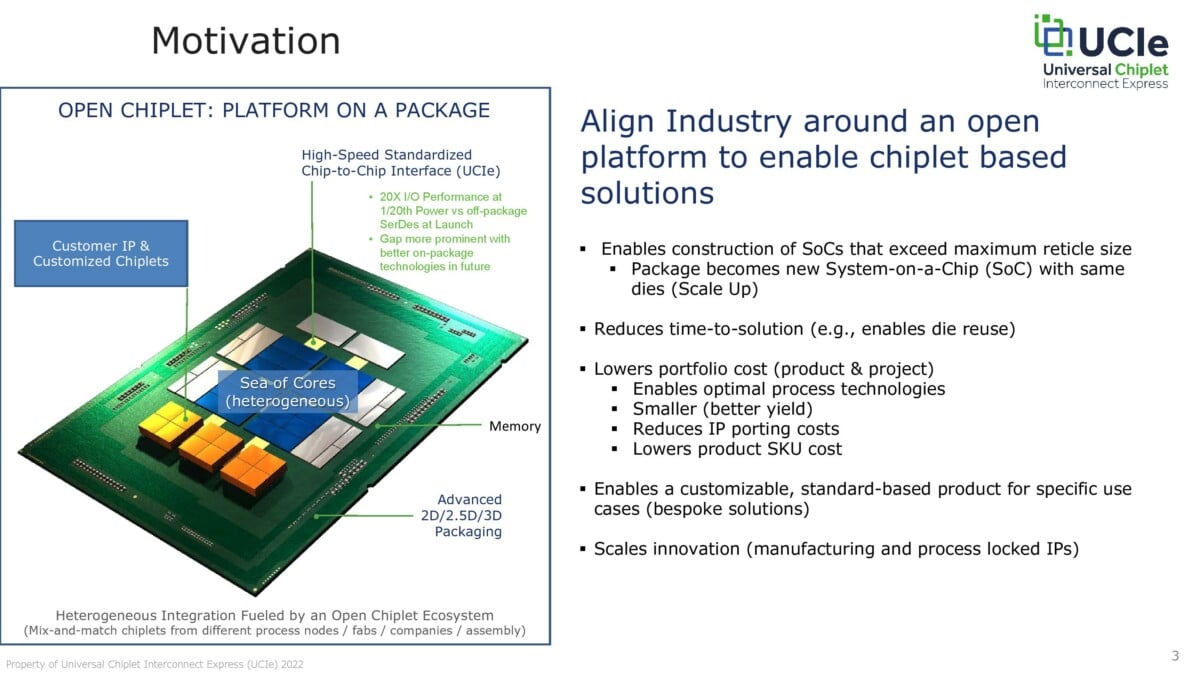

Du côté d’Intel, les utilisations de ce genre de technologies sont encore assez rares : les CPU Alder Lake de la marque, malgré leur architecture hybride combinant des cœurs puissants et d’autres à faible consommation, sont toujours produits à partir d’un design monolithique, et les futurs Raptor Lake devraient suivre la même voie. Mais Intel a déjà expérimenté avec les processeurs MCM par le passé, principalement sur des modèles destinés aux entreprises ou sur des FPGA (Field Programmable Gate Array), des puces dont les portes logiques peuvent être reprogrammées pour en personnaliser l’usage. Le constructeur s’y intéresse d’autant plus qu’il fait partie de l’Universal Chiplet Interconnect Express (UCIe), un consortium visant à standardiser la fabrication et l’interconnexion de chiplets dans l’industrie. Il n’y est bien sûr pas seul, puisqu’on y compte d’autres grandes marques comme AMD, Arm, Google, Meta, Microsoft ou encore Qualcomm.

Cela nous amène au dernier avantage des chiplets pour l’industrie de manière générale, qui se rapporte à la modularité permise par ceux-ci. Pour reprendre l’exemple d’AMD, les CCD produits pour les Ryzen et Threadrippers ne se retrouvent pour le moment que dans les Ryzen et Threadripper, mais dans l’absolu, rien n’empêcherait la marque de vendre ses CCD à un autre constructeur souhaitant créer ses propres processeurs et utilisant la propriété intellectuelle d’AMD, et même de les combiner avec d’autres chiplets.

En réalité, c’est même déjà ce que fait AMD depuis 2019 : les fameux chiplets I/OD des Ryzen 3000 (et des modèles suivants) est fabriqué par un autre fondeur sur un procédé différent. Alors que les CCD sortent des usines de TSMC et sont gravés en 7 nanomètres, les I/OD proviennent de GlobalFoundries, qui fournit des dies de 12 ou 14 nm selon les modèles.

En cherchant à parvenir à un standard, l’UCIe vise donc la création de chiplets pouvant être réutilisés par différents constructeurs et dont l’interconnexion serait assurée par les règles qu’elle aura définies. En faisant marcher notre imagination, et au vu de la liste des constructeurs présents dans le consortium, nous pourrions parfaitement envisager un SoC embarquant un chiplet produit par Qualcomm pour le processeur, un GPU créé par AMD et un chiplet d’Intel permettant de profiter du Thunderbolt, du Wi-Fi 7 et des dernières avancées en date. Ce n’est bien sûr qu’un exemple, mais il donne une idée de ce que la création d’un tel standard ouvert pourrait permettre.

Pour l’heure, nous n’en sommes toutefois qu’aux stades préliminaires pour les différents constructeurs, qui cherchent d’autres partenaires pour grossir leurs rangs, mais une spécification claire et applicable par l’industrie n’est pas attendue dans l’immédiat. Mais ce genre d’initiative montre que la voie empruntée par AMD semble être la bonne, et laisse espérer de nouvelles innovations en matière de CPU, un domaine dans lequel les principaux constructeurs piétinaient quelque peu avant 2017.

Les bons plans n’attendent pas : abonnez-vous à notre canal WhatsApp Frandroid Bons Plans ! (zéro spam, promis).

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.