Avec l’avènement de la réalité augmentée et la popularité des modes portrait (entre autres), la gestion des profondeurs par les systèmes informatiques devient de plus en plus importante pour améliorer l’expérience de l’utilisateur ou encore le traitement de la photographie en trois dimensions.

Passez sur la gamme A de Samsung avec cette sélection de smartphone à 1€ avec le forfait Intégral de Bouygues Telecom ! Retrouvez notamment le Samsung Galaxy A57 5G disponible à partir de 1€ et profitez de la puissance 5G avec le forfait 250 Go à 29,99€/mois pendant un an chez Bouygues Telecom !

Après Face ID, premier système de reconnaissance faciale 3D embarqué dans un smartphone, l’iPhone X, Apple semble continuer sur sa lancée. On en apprend en effet un peu plus sur un projet de reconnaissance des profondeurs grâce au dépôt d’un brevet par la marque à la pomme.

Apple bosse sur la reconnaissance de profondeur

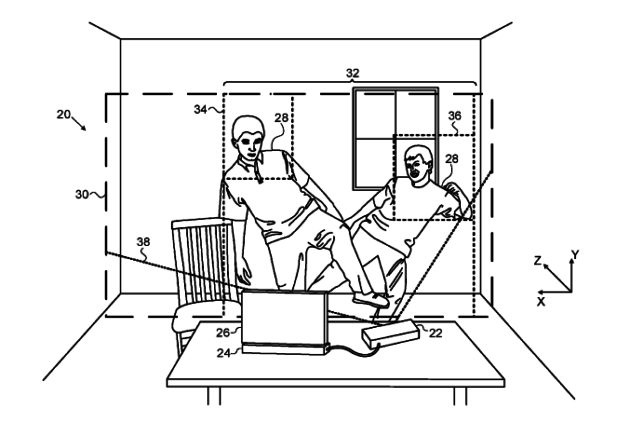

Grâce à une série de dessins illustrant la technologie, on comprend que le système isole chaque élément du plan et l’analyse pour en déduire sa distance avec l’objectif. Ainsi, la machine est théoriquement capable de cartographier la scène en trois dimensions.

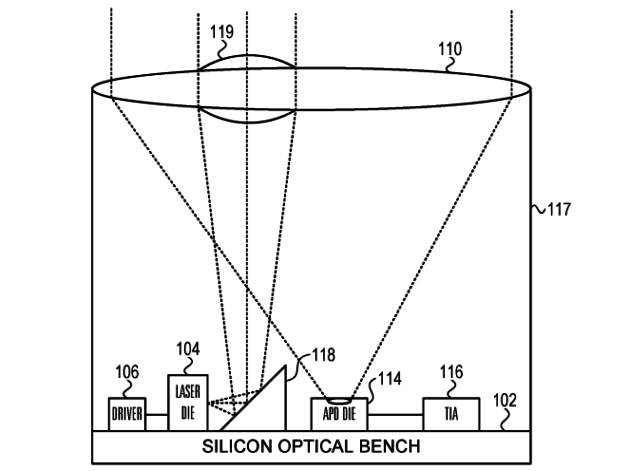

Pour ce faire, le système balaye la scène à l’aide d’un laser lumineux, à l’instar d’un scanner, afin d’en déterminer la profondeur.

Brevetée sous le nom « Moteur d’analyse de la profondeur » (« scanning depth engine »), cette technologie n’est en aucun cas assurée de figurer dans la liste des fonctionnalités d’un produit Apple à l’avenir puisque de nombreux brevets ne débouchent sur aucun produit fini. Néanmoins, on peut facilement imaginer ce genre de système être implémenté dans un prochain iPhone, dans la continuité de ce qu’Apple a déjà proposé avec le Face ID par exemple.

Pour aller plus loin

L’iPhone SE 2 arborerait lui aussi une encoche, potentiellement pour le Face ID

sur ! si tu achètes un SUV https://uploads.disquscdn.com/images/4d0469b3a2bdbf65f58b9ca57943d1ddc311238df5e67a32dd94919cd2cb69eb.jpg

Moi ça me fait penser aux pubs Ikea, où on peut visualiser ce que donnerait un nouveau meuble dans la maison depuis son smartphone... Mais à part ça, je ne vois pas vraiment d'autres applications possibles pour le moment

Dans un Sony on peu le faire grace au 3D Creator .

Quel intérêt?

Pas compris

En termes de cartographie, est-ce que le résultat sera aussi rapidement bon que pour Plans ?

Le niveau des commentaires vole haut ...

C'est déjà bouché ! xD

Ils veulent breveter le projet tango ?

Ne veulent pas sonder l'anus en même temps ?

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.