Les textes générés par ChatGPT ou Claude sont omniprésents. Dans nos échanges professionnels, dans les avis sur les plateformes d’e-commerce, et inévitablement dans les articles publiés par certains médias. Ces nouvelles intelligences artificielles, bien que pratiques, présentent quelques défauts majeurs : elles sont loin d’être infaillibles et facilitent grandement la propagation d’informations erronées.

Les solutions pour y remédier ne sont pas légion. Bien que certaines entreprises s’efforcent de développer des détecteurs de contenu généré par l’IA, ceux-ci manquent de précision et peuvent même accuser des textes rédigés par des humains.

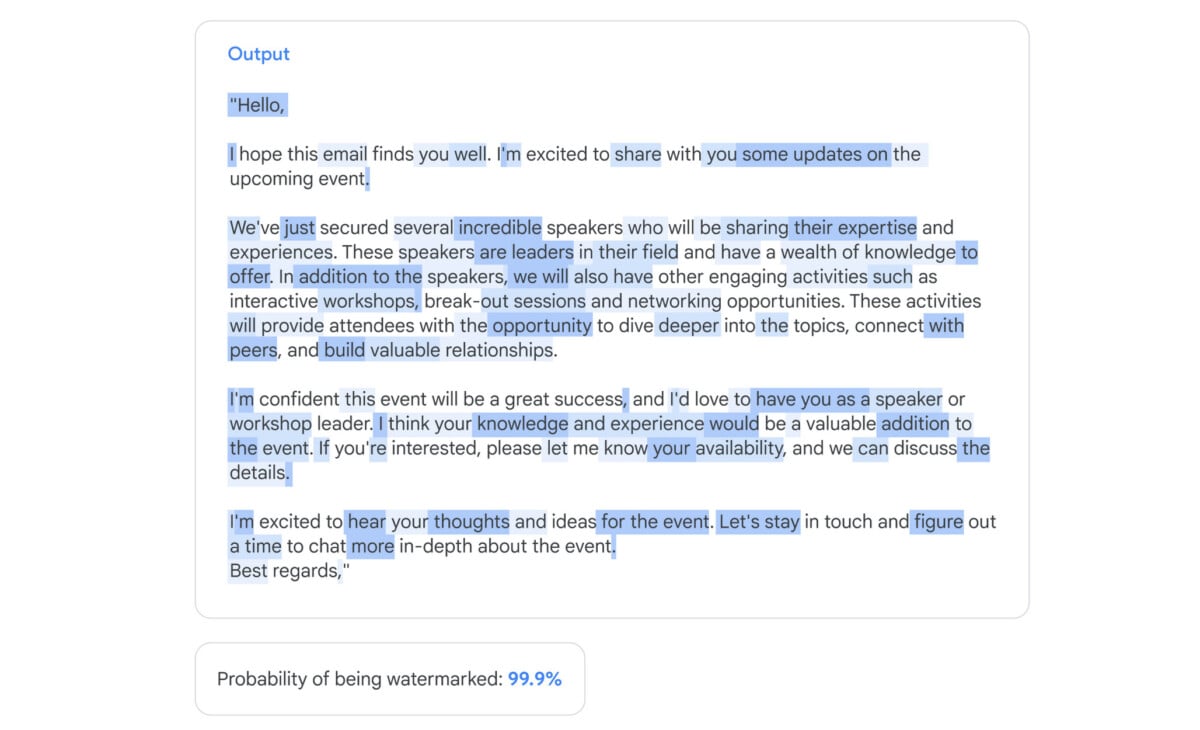

Il est cependant possible pour les développeurs d’apposer un filigrane sur leurs contenus générés par l’IA. C’est le rôle joué par SynthID Text de DeepMind, filiale de Google, qui permet d’identifier les résultats textuels produits par l’intelligence artificielle, de manière invisible pour les lecteurs.

Pour ce faire, l’outil modifie légèrement le mode de fonctionnement des IA, en affectant les tokens (ou jetons) qui leur permettent de deviner les mots ou les lettres qui doivent apparaître au fur et à mesure de leur travail. Il en résulte un motif reconnaissable par SynthID Text, qui ne « compromet pas la qualité, la précision, la créativité ou la rapidité de la génération de texte » selon les propos de DeepMind dans un billet de blog.

Un outil qui n’est pas infaillible, mais qui pourrait s’avérer obligatoire

Bien sûr, SynthID Text n’est pas sans faiblesses. DeepMind souligne qu’il « fonctionne mieux lorsqu’un modèle de langage génère de longues réponses ». Il peut même détecter des textes paraphrasés, mais commence à montrer ses limites avec des résultats courts, des traductions ou des réponses très factuelles. Les textes qui ont été réécrits par des humains peuvent également avoir une incidence sur les performances de l’outil.

Ce dernier est intégré de facto dans Gemini depuis le printemps dernier, et est désormais disponible gratuitement pour les développeurs et les entreprises sur la plateforme Hugging Face. Si ces dernières ne sont pas obligées, pour l’instant, d’utiliser de tels outils dans leurs processus, certains régulateurs pourraient les y contraindre dans les mois et années à venir, notamment en Californie, comme le rapporte TechCrunch.

Et il pourrait bien s’agir d’une véritable urgence. D’après une étude d’Europol, pas moins de 90 % du contenu sur Internet pourrait être généré par l’intelligence artificielle d’ici à 2026. Un chiffre absolument délirant, qui met en péril notre capacité, en tant qu’internautes, à vérifier la véracité des informations que nous glanons ici et là sur le web.

Reste à voir qui de Google ou d’OpenAI, qui travaille depuis quelques années sur un outil semblable à SynthID Text, arrivera à imposer sa norme sur la question des filigranes.

Téléchargez notre application Android et iOS ! Vous pourrez y lire nos articles, dossiers, et regarder nos dernières vidéos YouTube.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.