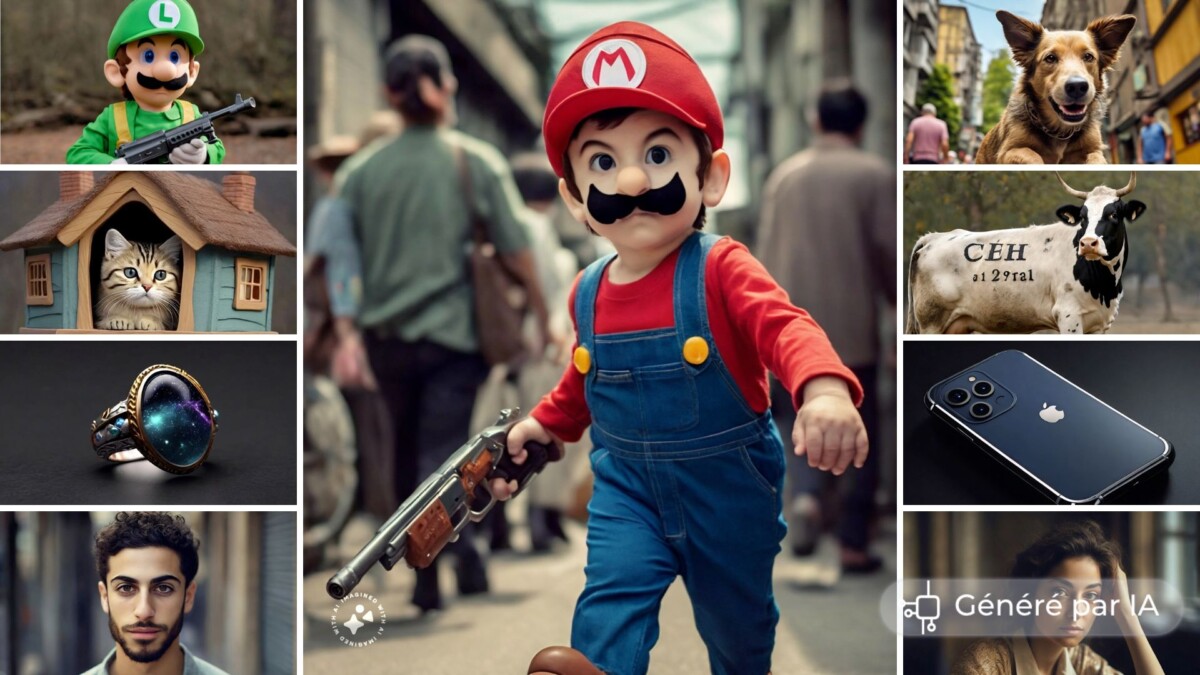

C’est un des grands défis en matière d’intelligence artificielle en 2024 : la détection des contenus générés par IA. C’est d’autant plus vrai pour les images photoréalistes artificielles. Meta se doit de participer à relever ce défi, d’autant plus que l’entreprise propose Imagine With Meta AI, un outil de génération d’images gratuit.

Pour aller plus loin

On a testé l’IA de Meta qui génère des images : il y a du bien, il y a du moins bon

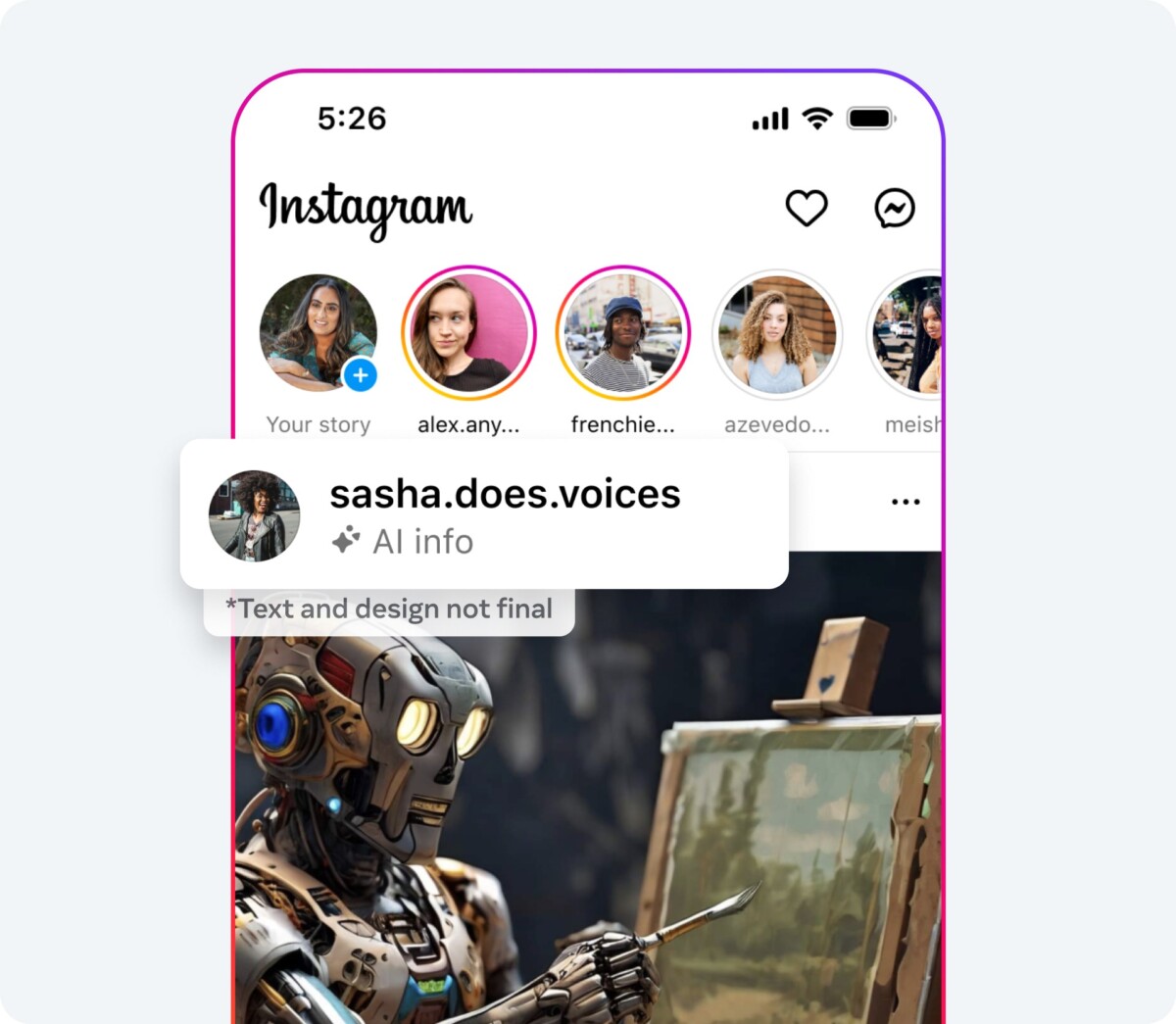

Des « signaux » pour détecter les images générées par IA publiées sur Facebook, Instagram ou Threads

Dans un communiqué, Meta déclare avoir travaillé avec certains partenaires de l’industrie pour créer « des normes techniques communes qui indiquent qu’un contenu a été créé à l’aide de l’IA. » Cela autour du Partnership on AI (PAI), qui rassemble des acteurs technologiques importants, comme Adobe, Amazon, Apple, Google, Intel, Microsoft, OpenAI ou encore Samsung. Ce sont ces normes qui permettront à Meta d’étiqueter les images concernées sur ses trois réseaux sociaux, Facebook, Instagram et Threads.

Cet ajout arrivera dans les mois à venir et progressivement dans toutes les langues des trois applications. L’objectif, c’est d’y arriver dans les prochains mois ainsi que d’ici la fin de l’année, puisque d’importantes élections se dérouleront en 2025. Cela ne fonctionne pour le moment que sur les images, mais pas sur les vidéos ou les audios. Meta indique que les entreprises qui proposent des générateurs n’ont pas commencé à inclure des systèmes de filigranes sur ces types de fichiers.

Du côté des utilisateurs, Meta souhaite les forcer à étiqueter les contenus générés par IA comme tel. Auquel cas ils s’exposeront à des sanctions de la part de Meta. On ne connaît pas la nature des sanctions prévues. Par ailleurs, ce 6 février, OpenAI a officialisé son système de filigrane pour les images générées via son outil Dall-E 3, C2PA. Au-delà de la volonté de Meta d’être honnête avec les utilisateurs de ses réseaux sociaux, l’entreprise pourrait à l’avenir ne pas avoir le choix. Les législations du monde entier se penchent sur l’intelligence artificielle générative et certaines souhaiteraient que les contenus qu’elle génère soit indiqués comme tels. C’est le cas des États-Unis, qui pourraient adopter leur propre technologie. Dans l’Union européenne, c’est l’AI Act qui pourrait légiférer dessus : la loi est en cours de rédaction et de négociations.

L’outil de génération d’images de Meta aussi se met à étiqueter les contenus

Meta souhaite montrer patte blanche, y compris avec son propre outil, pour le moment en bêta (et indisponible en France pour le moment) : Imagine With Meta AI. La société précise que lorsque des images photoréalistes sont générées, l’outil prend plusieurs dispositions. Il place des marqueurs visibles sur les images, mais également invisibles, via un système de filigrane et de métadonnées dans les fichiers de l’image. Concernant les métadonnées, elles peuvent être modifiées a posteriori pour tromper : cette méthode est loin d’être infaillible.

C’est pourquoi dans le même temps, Meta développe des outils de détection d’images générées par IA. Un travail qui va de pair avec le fait d’empêcher la suppression des filigranes : c’est la technologie en développement au de son laboratoire dédié à l’IA, FAIR, qui se nomme Stable Signature. Meta précise que cette dernière « intègre le mécanisme de filigrane directement dans le processus de génération d’images pour certains types de générateurs d’images, ce qui pourrait être utile pour les modèles open source afin que le filigrane ne puisse être désactivé. »

Tous nos bons plans directement sur WhatsApp. Rejoignez Frandroid Bons Plans, zéro spam garanti.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.