Compatible uniquement avec le triptyque d’iPhone annoncé début septembre, Deep Fusion veut améliorer nos clichés en intérieur (mais pas seulement), à grand renfort de machine learning et de réseaux neuronaux.

Le principe de fonctionnement de cette nouvelle technologie est à la fois simple et sophistiqué : votre iPhone 11 prendra quatre clichés avant même le déclenchement de l’obturateur, puis quatre photos supplémentaires une fois l’obturateur actionné. Un ultime cliché avec pose longue vient enfin conclure ce cheminement pour capturer un maximum de détails.

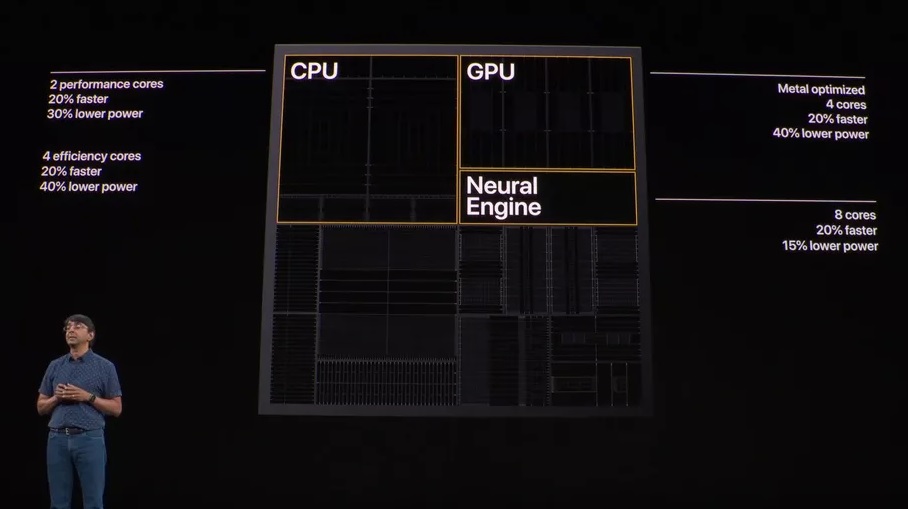

Quand les 8 cores neuronaux de l’A13 Bionic œuvrent en silence…

Dès la prise des quatre premiers clichés, l’A13 Bionic et les huit cores de son moteur neuronal entrent en action pour sélectionner les meilleures images et composer une photo HDR de haute qualité. Si l’on s’en tient aux promesses d’Apple, le fruit de ce processus n’est autre qu’un cliché final plus détaillé, plus net et surtout plus naturel.

Apple compte aussi beaucoup sur les capacités de son nouveau SoC en matière de machine learning. L’IA de la puce sera chargée d’analyser les images capturées pour procéder différemment en fonction de la scène photographiée, et ce afin d’optimiser le rendu de certains éléments spécifiques (le ciel, les feuillages, ou encore la couleur de peau de sujets photographiés). La structure des clichés et le calibrage des couleurs sont en revanche pris en charge par les réseaux neuronaux, note GSMArena.

Reste la grande question de l’arrivée de cette technologie Deep Fusion sur les nouveaux iPhone. Prévue pour un lancement en décalé, cette dernière doit débarquer sur la bêta d’iOS 13.2, accessible aux développeurs dans un premier temps et en bêta public par la suite. Initialement TechCrunch avait annoncé sa disponibilité hier avant de se raviser un peu plus tard.

Au travers de Deep Fusion, Apple — qui a déjà réalisé une belle avancée sur la photo avec ses derniers iPhone — tient peut-être la fonctionnalité qui fera la différence. Réponse sous peu…

Si vous voulez recevoir les meilleures actus Frandroid sur WhatsApp, rejoignez cette discussion.

:D au moins ça m'a fait rire, ça fait du bien et tu n'as pas vraiment tort.

Je suis déçu Tu as changé ta phrase , la première fois c'etait simple Maintenant tu te sens obligé de me dire un gros mot Et en plus de ça tu me traites de femme Je pensais que toi et moi on s'appreciait !

Tu peux la fermer pour l'éternité ?

Un (plutôt deux) bien grand mot pour pas grand chose ...

N'importe quoi. C'est Apple qui t'as dit ça ?

L'iPhone 11 n'en a que 2. Par contre ce ne sont pas les mêmes que les iPhones précédents puisqu'on le téléphone est remplacé par l'ultra grand angle.

Ouais ma konn, je suis là 🤓

Sauf que l'option fonctionne avec les 3 apn.

Pour avoir des photos floues et fluos au final, on se demande l’intérêt.

Ouahh... Trop cool 😎

Frapple

Donc basiquement à chaque photo on perd 5% de batterie

Ca fait un peu usine à gaz pour prendre des photos avec un tél, non?

Apple doit vraiment ajouter cette fonctionnalité aux anciens iPhones. Ils te promettent le meilleur CPU et une année plus tard ils te diront que c'est pas assez puissant. Quand je vois le Galaxy S9 avec les fonctionnalités du Note 10 ou le premier Google pixel avec tout les algorithmes de pixel 4 😒

Attention Coyote va debarquer et faire la promotion de son superbe smartphone

En fait, le message d'Apple, c'est achetez nos téléphones aujourd'hui, ils feront des plus belles photos dans 6 mois...

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.