L’accessibilité n’est décidément pas un sujet pris à la légère chez Apple. Le sujet dispose déjà d’un site dédié. À l’occasion de la Journée mondiale de sensibilisation à l’accessibilité ce jeudi 20 mai, la marque à la pomme dévoile les prochaines innovations pour offrir ses produits et services au plus grand nombre.

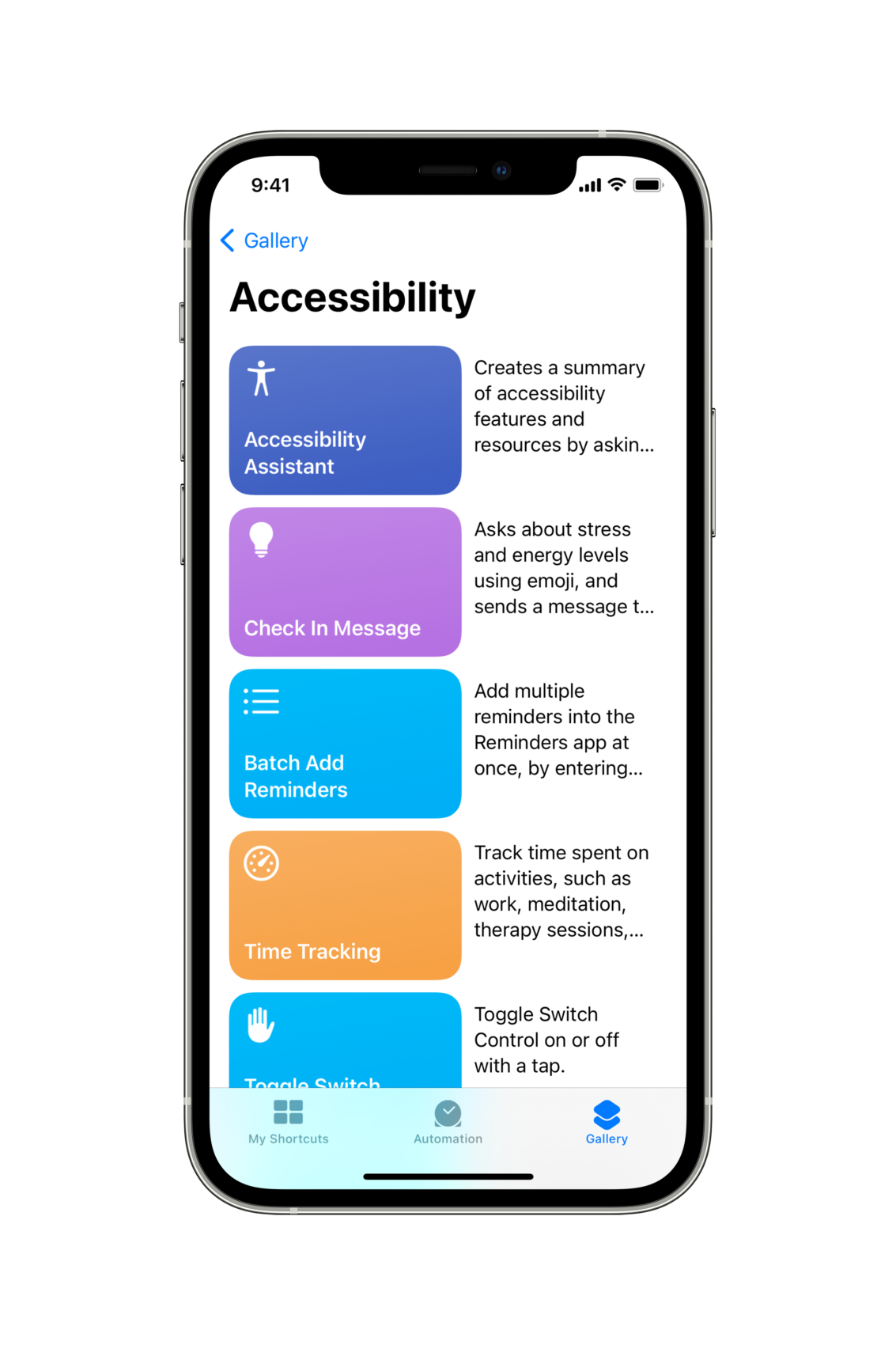

Que ce soit sur l’iPhone, l’iPad, le Mac et même l’Apple Watch, les fonctions d’accessibilité sont déjà nombreuses. Apple va encore plus loin en améliorant certaines fonctions sur ses produits. À commencer par l’iPhone et l’iPad qui vont hériter de routines autour de l’accessibilité avec l’aide de Siri. Un menu dédié à l’accessibilité va permettre de découvrir d’autres routines et comment les configurer.

Utiliser l’Apple Watch sans toucher l’écran

Petit format par définition, l’Apple Watch n’est pas forcément l’objet le plus facile à utiliser pour un utilisateur ayant des problèmes de motricité ou de vision. Pour ces derniers, il y avait la possibilité d’agrandir la police ou d’utiliser VoiceOver pour avoir la dictée de toutes les fonctions. Mais pour les personnes ayant un handicap physique au niveau des membres supérieurs, l’utilisation de la montre connectée s’avérait compliquée.

Lors de la prochaine mise à jour de watchOS 7, l’Apple Watch va s’enrichir d’AssistiveTouch, une fonctionnalité d’accessibilité qui permet d’utiliser l’appareil sans avoir à toucher l’écran ou les commandes. Pour cela, les capteurs de mouvement (gyroscope, accéléromètre) vont entrer en action ainsi que le capteur de fréquence cardiaque.

Épaulée par les fonctions d’apprentissage automatique, la montre pourra détecter les différents mouvements musculaires et l’activité des tendons, même subtils, afin de permettre la navigation avec un curseur qui apparaît sur l’écran. L’utilisateur n’aura qu’à réaliser des gestes de la main comme une pincée ou une fermeture des doigts pour réaliser des actions comme répondre à un appel, valider un menu. Faire tourner son poignet déplacera également le curseur.

Cela peut être très utile pour les personnes qui ont des différences de membres et pourront alors répondre plus facilement aux appels, accéder aux notifications, aux apps, etc. en contrôlant ainsi le pointeur de mouvement sur l’écran.

L’iPad va intégrer le suivi oculaire

Si vous souffrez d’un handicap visuel, de nombreuses améliorations sont annoncées comme la prise en charge de dispositifs de suivi oculaires par l’iPad dans la prochaine version d’iPadOS. Il sera alors plus simple de contrôler la tablette uniquement avec les yeux en regardant l’écran. Le pointeur suivra alors votre regard pour réaliser une action, avec le soutien d’appareils compatibles.

Les paramètres d’affichage et de taille du texte évoluent. Ils pourront être bien plus personnalisés désormais dans chaque application compatible afin de s’adapter au handicap de chacun.

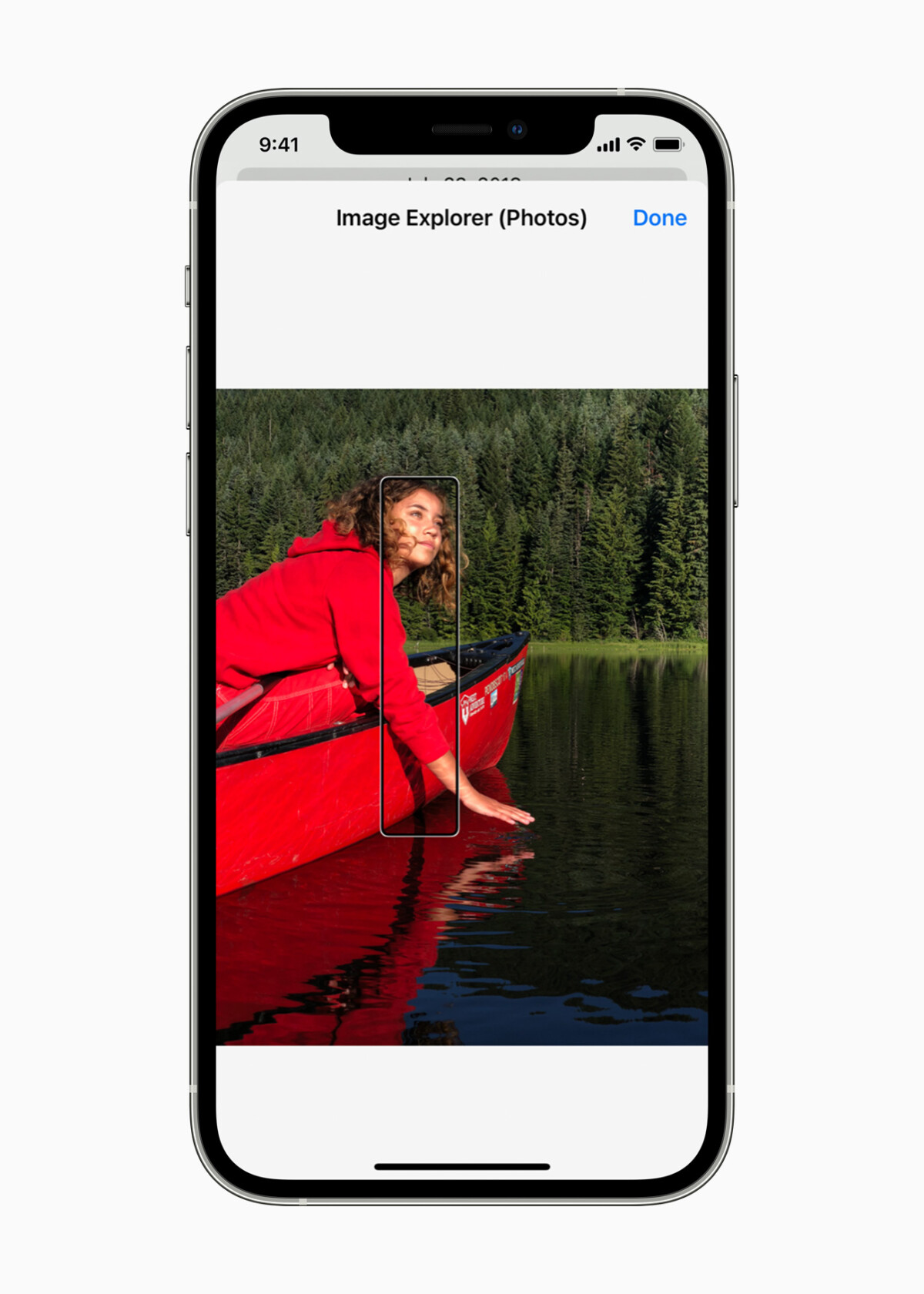

Par ailleurs, malentendants et malvoyants vont profiter des nouveautés apportées à VoiceOver. Le lecteur d’écran profite depuis quelque temps de la description d’images. Il va désormais être capable de fournir plus de détails sur les personnes, les textes, les objets et toute autre donnée d’une image. Les utilisateurs pourront ainsi parcourir une photo ou une image en profitant d’une description plus pointue par VoiceOver. Cela fonctionne aussi pour un tableau reçu qui pourra être détaillé colonne par colonne, ligne par ligne. Pour les valides, la fonction Markup va permettre d’ajouter ses propres descriptions à une image envoyée à une personne handicapée.

Le son renforcé pour une meilleure immersion dans le monde réel

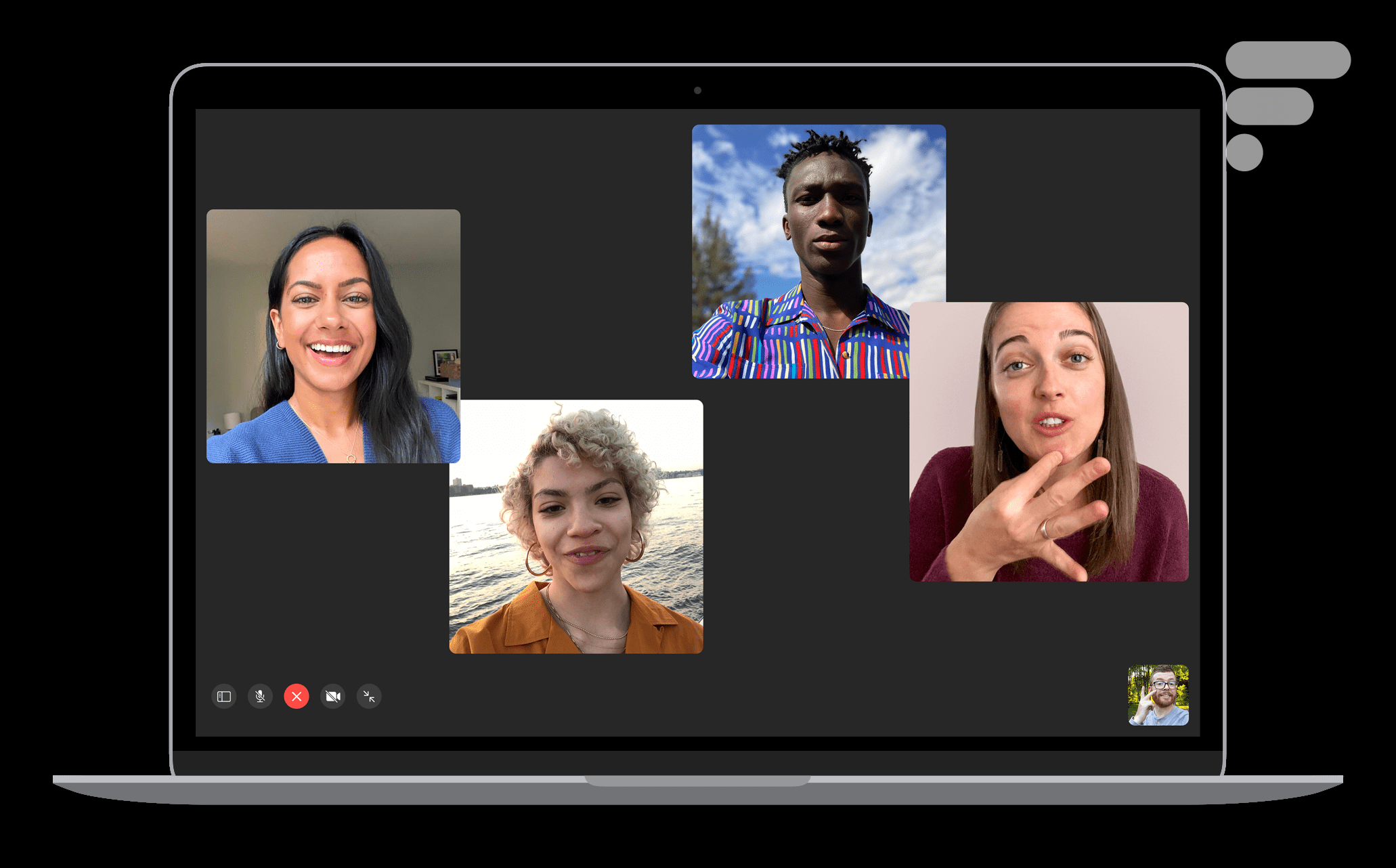

Pour rester en contact avec le monde qui nous entoure, l’ouïe reste un sens essentiel. Et pour cela, Apple va renforcer la prise en charge de dispositifs d’aide auditive bidirectionnelle notamment. Les micros de ces nouvelles aides auditives permettront d’utiliser les fonctions mains libres en appel téléphonique ou avec FaceTime. Il faut pour cela qu’ils disposent du label Made For iPhone.

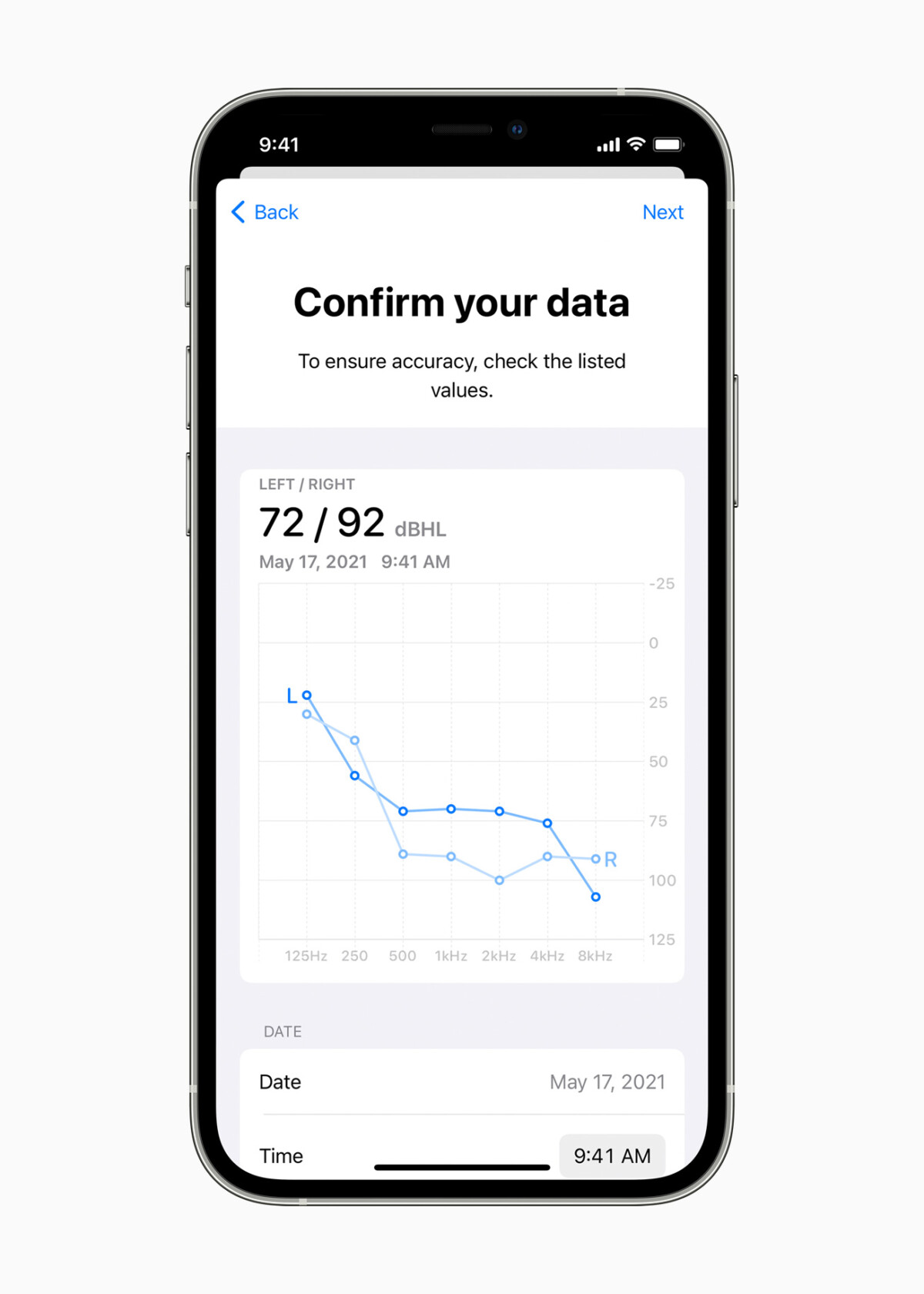

Les appareils Apple vont aussi reconnaître les audiogrammes, ces graphiques qui affichent le résultat d’un test auditif. Cela permettra de mieux ajuster certaines fréquences en fonction de l’audition de la personne, ou d’amplifier les sons doux. Il suffira d’intégrer ses derniers bilans auditifs (papier ou PDF) pour ensuite personnaliser les réglages.

Et si l’utilisateur est muet ou connaît des difficultés pour s’exprimer, la nouvelle fonction Sound Actions for Switch Control va permettre de remplacer les boutons physiques et autres switches par des bruits de bouche (clic, pop, « ee »…).

Pour soutenir la neurodiversité, Apple va également introduire de nouveaux sons d’arrière-plan pour aider à minimiser la distraction. En limitant les sons du quotidien qui peuvent s’avérer inconfortables ou trop distrayants, des bruits équilibrés, radieux ou plus sombres, des sons de pluie, d’océan ou autres peuvent alors être diffusés en continu en arrière-plan.

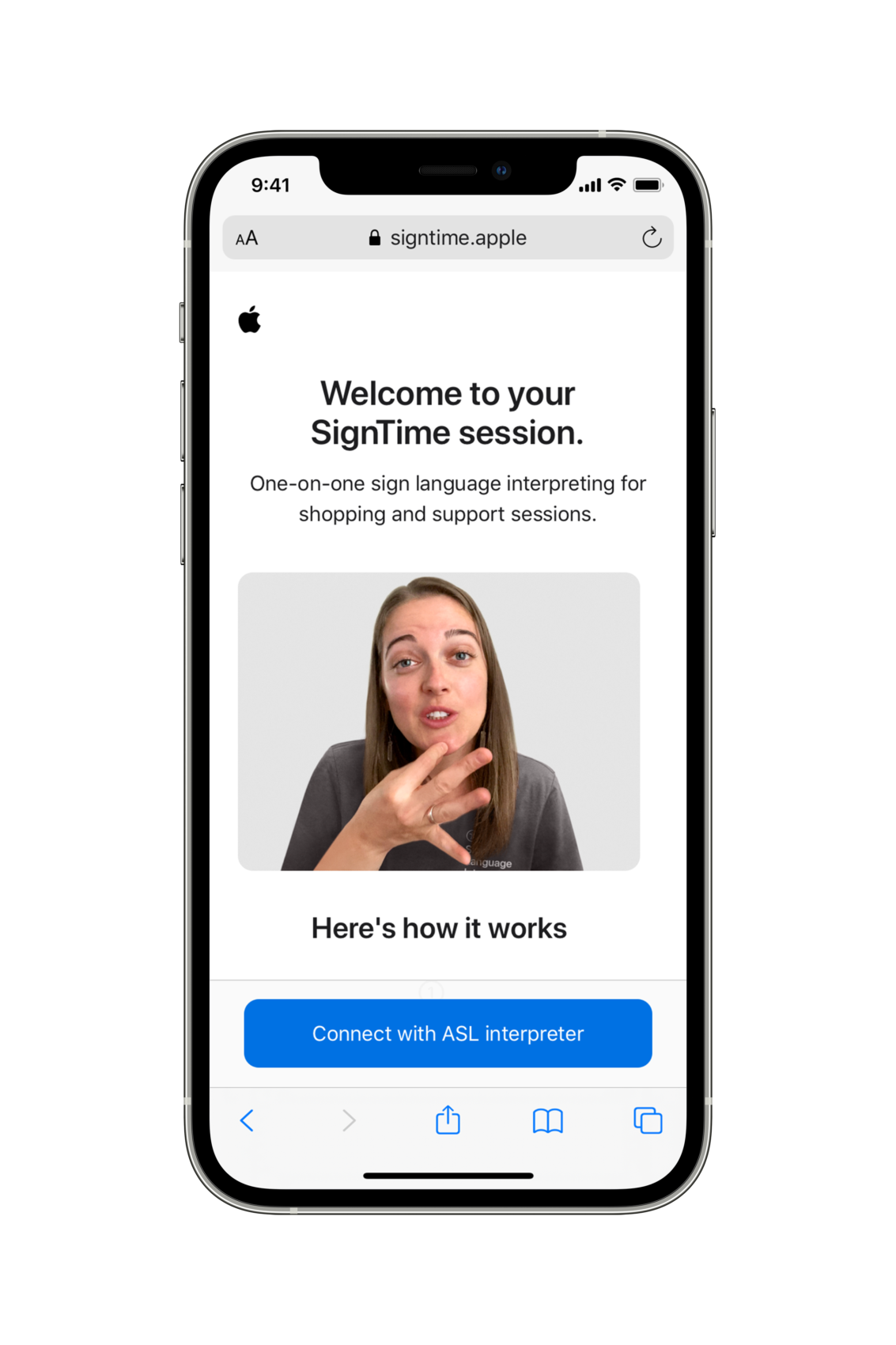

SignTime, le service client en langue des signes

Mais la grande nouveauté qui arrive chez Apple, c’est la mise en place d’un service nommé SignTime à compter de ce jeudi 20 mai. Les clients pourront qui font appel à l’Apple Store ou au service AppleCare depuis leur navigateur web vont pouvoir bénéficier d’une traduction en Langue des signes, et ce, même en français. Pas besoin de réserver en avance un interprète pour cela.

SignTime sera déployé dans un premier temps aux États-Unis, au Royaume-Uni et en France. « Nous pensons depuis longtemps que la meilleure technologie au monde doit répondre aux besoins de chacun », explique Sarah Herrlinger, responsable des politiques et initiatives d’accessibilité chez Apple. « Et nous travaillons sans relâche pour intégrer l’accessibilité dans tout ce que nous concevons. Avec ces nouvelles fonctionnalités, nous repoussons les limites de l’innovation avec des technologies de nouvelle génération qui apportent le plaisir et la fonctionnalité de la technologie Apple à encore plus de gens. »

Toutes ces fonctions seront progressivement déployées au cours des prochains mois sur iPhone, iPad ou Apple Watch. Pour cette Journée mondiale de la sensibilisation à l’accessibilité, Apple organise également des événements en ligne avec du contenu autour du handicap mis en avant sur Apple TV, l’App Store ou encore parmi les recommandations Apple Livres. Des sessions Today At Apple dans certains Apple Store permettront, en langue des signes, de découvrir les fonctions essentielles sur iPhone ou iPad qui peuvent aider les personnes handicapées. De nouveaux Memoji vont également voir le jour pour que chacun puisse se représenter avec son handicap, quel qu’il soit.

Pour aller plus loin

Accessibilité : 7 applis pour faciliter la vie en cas de handicap

Tous nos bons plans directement sur WhatsApp. Rejoignez Frandroid Bons Plans, zéro spam garanti.

C'est juste dingue comme fonctionnalités. Trop envie de tester le pointeur sur la montre qui peut servir si on a l’autre bras occupé. Apple joue fort. Alors que Google présent Wear, avec juste un système unifié et plus rapide comme promesse, chose que l'Apple Watch fait depuis des années, Apple sort ça, ce qui confirme leur énorme avance.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.