Alors que Midjourney v6 est sorti il y a quelques semaines, les internautes testent la dernière version de l’outil de génération d’images par IA. Les rendus n’ont jamais été aussi photoréalistes, tant et si bien qu’il devient de plus en plus difficile de les détecter.

Il y a encore quelques mois, on se moquait des mains générées par les outils de génération d’images. Aujourd’hui, c’est plus compliqué de pointer du doigt le manque de texture des peaux. Ce qui rend la détection de ces photos de plus en plus difficile, comme le montrent certaines images générées par Midjourney v6.

Pour aller plus loin

Nos astuces pour reconnaître les photos créées par IA (Midjourney, Dall-E, Stable Diffusion, Microsoft Designer, etc.)

Les progrès fulgurants de Midjourney v6

Il y a quelques semaines, Midjourney dévoilait sa v6 en version de prévisualisation. Une version toujours en alpha, qui améliore la cohérence des images, la rapidité de compréhension ou encore la génération de dessins textuels.

Les progrès par rapport à la v5 semblent importants, en témoignent les textures des peaux, moins lisses et plus réalistes. Idem pour la pilosité. Les flous et les jeux de lumière sont eux aussi plus réalistes et plus prononcés.

Des images volontairement « dégradées »

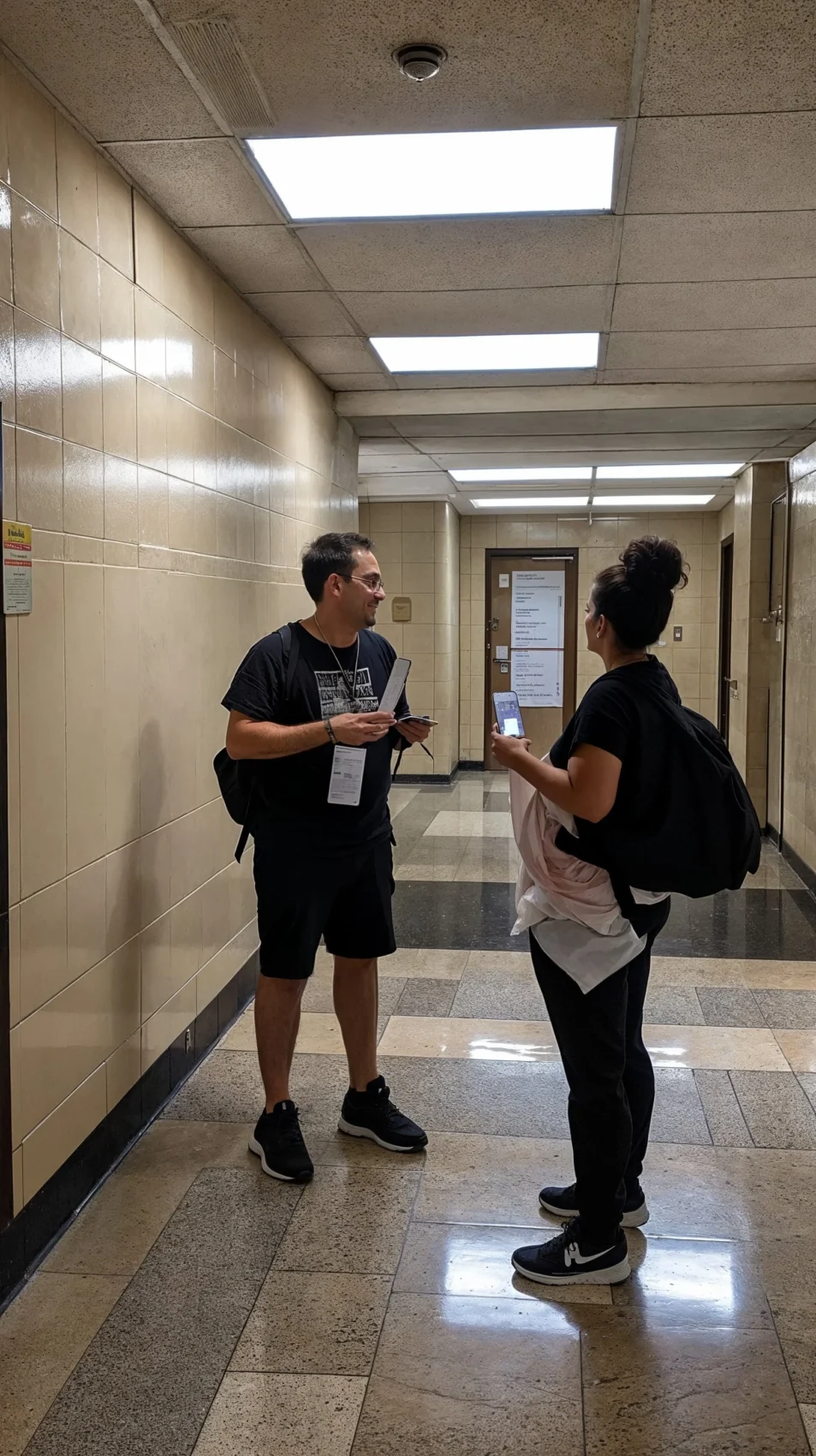

Il y a quelques jours, un utilisateur du nom de KudzuEye a partagé sur Reddit des images générées avec Midjourney v6 qui sont pour le moins troublantes. Troublantes de photoréalisme : les détails sont là et les « photos » paraissent tout droit sorties de n’importe quel smartphone.

Et pour cause : il a utilisé une petite astuce qui vient donner tout ce réalisme. Il demande en effet à Midjourney de générer une photo dans le style d’une « photo de téléphone ». Et ça tombe bien : Internet et ce avec quoi a été entraîné le modèle regorgent de photographies prises avec un smartphone. L’utilisateur ajoute avoir utilisé Magnific AI, un outil d’amélioration d’images basé… sur l’IA. De quoi « nettoyer certains visages en arrière-plan et les peaux trop lisses, bien que cela ait pu ajouter quelques visages bizarres. Il y a quelques mains qui n’ont pas pu être corrigées avec ce logiciel », raconte KudzuEye sur Reddit.

Parce qu’on est habitués à voir tous les jours des photos prises avec des smartphones, on est plus facilement trompés que si l’on avait un portrait au format carré comme Midjourney sait en générer. Et si les « photos » paraissent photoréalistes, elles ne sont pas exemptes de défauts. Et comme d’habitude, ils se situent au niveau des mains, avec des phalanges illogiques, ou des jambes qui se dupliquent.

De l’importance d’une législation sur l’IA

Si en analysant les images en zoomant simplement dessus on peut déterminer si elles sont artificielles ou non, cela pourrait ne plus être le cas. De plus, ces images peuvent aisément circuler sur les réseaux sociaux. Comme l’a rappelé le journaliste William Reymond sur X, des tweets, « souvent illustrés par des photos générées par IA », tentent de montrer que Bill Clinton et Donald Trump sont présents sur la liste des clients de Jeffrey Epstein. Une liste qui serait très prochainement rendue publique par la justice américaine.

Outre la responsabilité des réseaux sociaux qui pourrait être engagée, il faut se pencher sur l’évolution des législations dans le monde entier. On sait que des organismes étatiques américains et britanniques se penchent dessus. Plus important encore : l’Union européenne s’est accordée le mois dernier sur l’AI Act, une législation importante en matière d’intelligence artificielle. Elle prévoit de forcer l’identification des contenus générés par IA. Autrement dit, légalement, les images publiées devront pouvoir être identifiée comme étant artificielles. L’AI Act pourrait entrer en vigueur en 2025. Par ailleurs, plusieurs nations ont établi la création d’un réseau de recherche scientifique sur la sécurité de l’IA en novembre dernier, qui lui aussi pourrait réaliser des travaux importants en la matière.

Envie de retrouver les meilleurs articles de Frandroid sur Google News ? Vous pouvez suivre Frandroid sur Google News en un clic.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix